Trong học máy (Machine Learning), việc hiểu và áp dụng đúng thỏa hiệp giữa bias và variance (Bias-Variance Tradeoff) là một yếu tố quan trọng để tối ưu hóa hiệu suất mô hình. Bias và variance ảnh hưởng trực tiếp đến độ chính xác và khả năng tổng quát của mô hình. Bài viết này sẽ giúp bạn tìm hiểu về Bias-Variance Tradeoff là gì, vai trò của thỏa hiệp Bias-Variance, tầm quan trọng trong quá trình xây dựng mô hình, cũng như cách áp dụng và điều chỉnh thỏa hiệp này để đạt được kết quả tốt nhất. Đọc ngay!

Tìm hiểu về Bias-Variance Tradeoff

Bias là gì?

Bias (độ thiên lệch) là sự khác biệt giữa dự đoán giá trị của mô hình Học Máy và giá trị đúng. Khi độ thiên lệch cao, lỗi trong quá trình huấn luyện cũng như kiểm tra dữ liệu sẽ lớn.

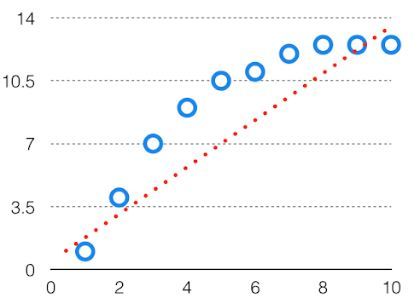

Người ta khuyến nghị rằng một thuật toán nên có độ thiên lệch thấp để tránh vấn đề thiếu phù hợp (underfitting). Khi độ thiên lệch cao, dữ liệu dự đoán thường nằm trên một đường thẳng, do đó không khớp chính xác với dữ liệu trong bộ dữ liệu.

Sự khớp này được gọi là “underfitting” (thiếu phù hợp với dữ liệu). Điều này xảy ra khi giả thuyết quá đơn giản hoặc có tính tuyến tính. Hãy tham khảo đồ thị dưới đây để xem ví dụ về tình huống này.

Variance là gì?

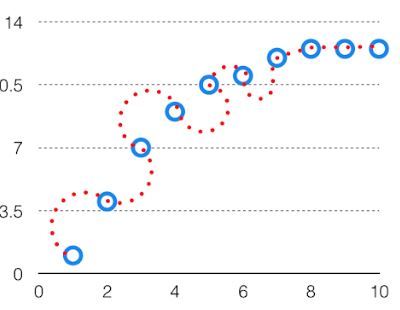

Variance (phương sai) là sự biến đổi trong dự đoán của mô hình đối với một điểm dữ liệu cụ thể, cho chúng ta biết mức độ phân tán của dữ liệu. Mô hình có phương sai cao sẽ có sự khớp phức tạp với dữ liệu huấn luyện và do đó không thể khớp chính xác với dữ liệu mà nó chưa thấy trước đây.

Kết quả là, những mô hình như vậy hoạt động rất tốt với dữ liệu huấn luyện nhưng có tỷ lệ lỗi cao với dữ liệu kiểm tra. Khi mô hình có phương sai cao, nó được gọi là “overfitting” (quá khớp với dữ liệu).

Overfitting là việc khớp dữ liệu huấn luyện chính xác thông qua các đường cong phức tạp và giả thuyết bậc cao, nhưng không phải là giải pháp vì lỗi với dữ liệu chưa thấy trước rất cao. Khi huấn luyện mô hình dữ liệu, phương sai cần được giữ ở mức thấp. Dữ liệu có phương sai cao trông như sau.

Bias-Variance Tradeoff

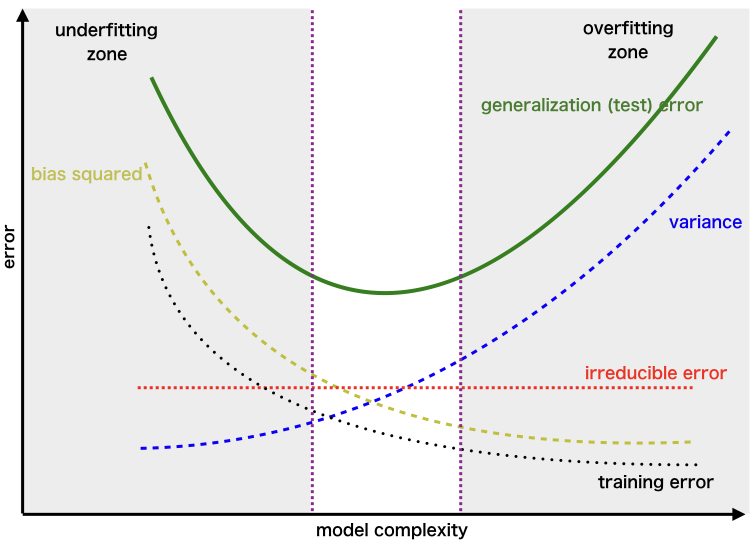

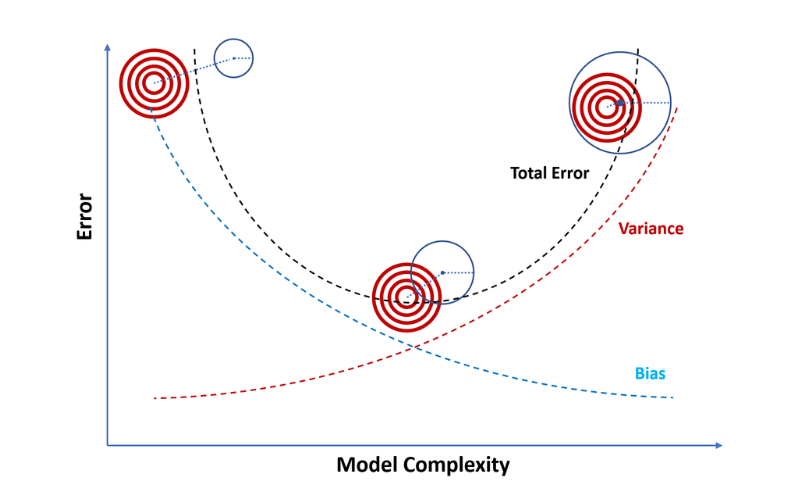

Nếu thuật toán quá đơn giản (giả thuyết với phương trình tuyến tính), nó có thể rơi vào tình trạng độ thiên lệch cao và phương sai thấp, dẫn đến khả năng mắc lỗi cao.

Nếu thuật toán khớp quá phức tạp (giả thuyết với phương trình bậc cao), nó có thể rơi vào tình trạng phương sai cao và độ thiên lệch thấp. Trong tình trạng sau, các giá trị mới sẽ không hoạt động tốt.

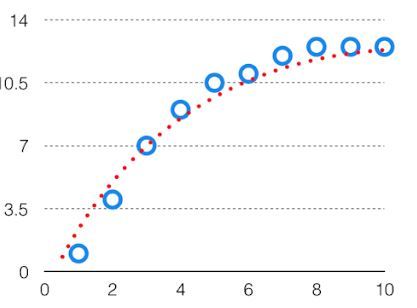

Tuy nhiên, có một trạng thái giữa hai điều kiện này, được gọi là Thỏa thuận hay Thỏa hiệp Bias-Variance. Thỏa hiệp trong độ phức tạp này là lý do tại sao có sự thỏa hiệp giữa độ thiên lệch và phương sai. Một thuật toán không thể vừa phức tạp hơn vừa đơn giản hơn cùng một lúc. Đối với đồ thị, thỏa hiệp lý tưởng sẽ như sau.

Mô hình phù hợp nhất sẽ được xác định bởi giả thuyết tại điểm thỏa hiệp. Đồ thị lỗi và độ phức tạp để thể hiện sự thỏa hiệp sẽ như sau – Đây được gọi là điểm tốt nhất được chọn cho việc huấn luyện thuật toán, mang lại lỗi thấp cả trong dữ liệu huấn luyện và dữ liệu kiểm tra.

Tầm quan trọng của thỏa hiệp Bias-Variance trong Machine Learning

Hơn cả chỉ số chính xác (Accuracy)

Khi đánh giá hiệu suất của mô hình Machine Learning, ngoài chỉ số chính xác (accuracy), chúng ta còn cần phải xem xét đến bias và variance. Mô hình cần đạt được sự cân bằng giữa hai yếu tố này để tối ưu hóa độ chính xác trên cả tập huấn luyện và tập kiểm tra.

Ảnh hưởng đến quyết định lựa chọn mô hình

Việc hiểu rõ thỏa hiệp bias-variance khi xây dựng mô hình Machine Learning giúp các nhà nghiên cứu lựa chọn mô hình và kỹ thuật phù hợp với bộ dữ liệu mà họ đang làm việc. Điều này cũng có thể tác động đến việc lựa chọn thuật toán, cấu trúc mô hình và các phương pháp tối ưu hóa.

Các trường hợp sử dụng của Bias-Variance Tradeoff

Thỏa hiệp Bias-Variance có thể áp dụng trong nhiều trường hợp sử dụng học máy, bao gồm:

- Dự báo tài chính: Đạt được các dự đoán chính xác về giá cổ phiếu, xu hướng thị trường và cơ hội đầu tư.

- Chẩn đoán y tế: Xây dựng các mô hình đáng tin cậy để chẩn đoán bệnh và đánh giá rủi ro bệnh nhân.

- Phân tích hành vi khách hàng: Hiểu sở thích của khách hàng và tối ưu hóa các chiến lược marketing.

- Xử lý ngôn ngữ tự nhiên (NLP): Phát triển các mô hình ngôn ngữ cho phân tích cảm xúc, chatbot và tạo sinh văn bản.

Các công nghệ liên quan đến Bias-Variance Tradeoff

Một số khái niệm và kỹ thuật liên quan giúp hiểu và quản lý Bias-Variance Tradeoff:

- Regularization (Chính quy hóa): Là kỹ thuật được sử dụng để kiểm soát độ phức tạp của mô hình và ngăn ngừa overfitting (quá khớp) bằng cách phạt các giá trị tham số lớn.

- Cross-Validation (Kiểm tra chéo): Là phương pháp đánh giá hiệu suất của mô hình trên nhiều tập dữ liệu con, giúp ước tính bias và variance.

- Ensemble Methods (Phương pháp tập hợp): Kết hợp nhiều mô hình để giảm phương sai và cải thiện hiệu suất dự đoán tổng thể.

Làm thế nào để đạt được Bias-Variance Tradeoff?

Như chúng ta đã học, độ thiên lệch và phương sai có sự phụ thuộc lẫn nhau. Nói cách khác, giảm độ thiên lệch của một mô hình sẽ dẫn đến việc tăng phương sai và ngược lại. Mối quan hệ này giữa độ thiên lệch và phương sai được gọi là thỏa hiệp bias-variance.

Cân bằng giữa độ thiên lệch và phương sai có thể được điều chỉnh trong các thuật toán cụ thể bằng cách thay đổi các tham số, như ví dụ dưới đây:

Đối với thuật toán k-láng giềng gần nhất (k-nearest neighbors), độ thiên lệch thấp và phương sai cao có thể được điều chỉnh bằng cách tăng giá trị của k, điều này sẽ làm tăng độ thiên lệch và giảm phương sai.

Đối với máy vector hỗ trợ (support vector machines), độ thiên lệch thấp và phương sai cao có thể được thay đổi bằng cách điều chỉnh tham số C, điều này sẽ tăng độ thiên lệch và giảm phương sai.

Đáng tiếc là không thể xác định các sai số thực tế của độ thiên lệch và phương sai khi chúng ta đang cố gắng dự đoán hàm mục tiêu. Tuy nhiên, độ thiên lệch và phương sai là những khung hữu ích để hiểu về hiệu suất của các thuật toán học máy khi đưa ra dự đoán.

Hiểu rõ Bias-Variance Tradeoff là gì là yếu tố không thể thiếu để tối ưu hóa hiệu suất của mô hình học máy. Việc quản lý đúng mức độ bias và variance giúp mô hình vừa không quá đơn giản (underfitting) cũng không quá phức tạp (overfitting), từ đó đạt được độ chính xác cao trên cả tập huấn luyện và tập kiểm tra.

Các công nghệ như regularization, cross-validation và ensemble methods đều đóng vai trò quan trọng trong việc kiểm soát bias và variance. Nếu áp dụng đúng các kỹ thuật này, bạn sẽ có thể cải thiện hiệu suất mô hình một cách đáng kể và đưa ra những dự đoán chính xác hơn trong các bài toán học máy thực tế.

Nếu bạn đang tìm kiếm một giải pháp hosting linh hoạt với chi phí hợp lý, việc thuê VPS chất lượng giá rẻ tại InterData chính là lựa chọn tối ưu. Với phần cứng thế hệ mới như CPU AMD EPYC và Intel Xeon Platinum, kết hợp SSD NVMe U.2, dung lượng tối ưu và băng thông cao, dịch vụ VPS của chúng tôi sẽ mang lại hiệu suất ổn định và tốc độ mạnh mẽ cho mọi dự án của bạn.

Với nhu cầu về khả năng mở rộng linh hoạt và băng thông cao, thuê Cloud Server giá rẻ tốc độ cao tại InterData sẽ đáp ứng tốt yêu cầu của bạn. Các cấu hình mạnh mẽ từ phần cứng cao cấp, như CPU AMD EPYC, Intel Xeon Platinum, cùng SSD NVMe U.2, giúp hệ thống của bạn hoạt động mượt mà, ổn định và tiết kiệm chi phí. Liên hệ với chúng tôi để biết thêm chi tiết về dịch vụ này!

INTERDATA

- Website: Interdata.vn

- Hotline: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh