Self-Attention là nền tảng cốt lõi phía sau sự thành công của các mô hình AI hiện đại như Transformer. Kỹ thuật này cho phép mô hình học sâu nhận biết mối liên hệ giữa các phần tử cách xa nhau trong chuỗi dữ liệu và xử lý thông tin một cách linh hoạt, hiệu quả. Bài viết sẽ giúp bạn hiểu rõ Self-Attention là gì, nguyên lý hoạt động, các lợi ích vượt trội và ứng dụng thực tiễn trong xử lý ngôn ngữ tự nhiên, hình ảnh và âm nhạc.

Self-Attention là gì?

Self-Attention, hay còn gọi là cơ chế Tự chú ý, là một kỹ thuật tiên tiến cho phép các mô hình học máy có khả năng nhận biết và học hỏi các mối liên hệ phụ thuộc tồn tại ở khoảng cách xa giữa các thành phần trong một chuỗi dữ liệu đầu vào có chiều dài biến đổi.

Đây được xem là một sự nâng cấp vượt trội so với các phương pháp trước đó, như Mạng Nơ-ron Hồi quy (Recurrent Neural Networks – RNN), vốn thường gặp khó khăn trong việc mô hình hóa hiệu quả các mối tương quan giữa những yếu tố cách xa nhau trong dữ liệu.

Hoạt động của Self-Attention dựa trên nền tảng của cơ chế “chú ý” (attention), nơi mô hình được hướng dẫn để tập trung vào những phần thông tin quan trọng nhất của dữ liệu đầu vào.

Cụ thể, trong một lớp Self-Attention, mỗi thành phần (yếu tố) của đầu vào sẽ được đem ra so sánh với tất cả các thành phần khác cùng chuỗi nhằm đánh giá mức độ liên quan hay tầm quan trọng tương đối của nó. Quy trình này giúp mô hình có thể học được các mối phụ thuộc xa và nắm bắt được các kết nối về mặt không gian hoặc thời gian ẩn chứa bên trong dữ liệu.

Cơ chế self-attention hoạt động như thế nào?

Self-attention trong các mô hình học sâu tương tự như hành vi tập trung có chọn lọc ở con người – cả hai đều liên quan đến việc tập trung vào các yếu tố quan trọng trong một bối cảnh rộng hơn để xử lý thông tin hiệu quả hơn.

Trong tâm lý học, đó là khả năng tập trung vào suy nghĩ hoặc hành vi của chính mình; còn trong học sâu, đó là khả năng tập trung vào những phần liên quan nhất trong chuỗi dữ liệu đầu vào.

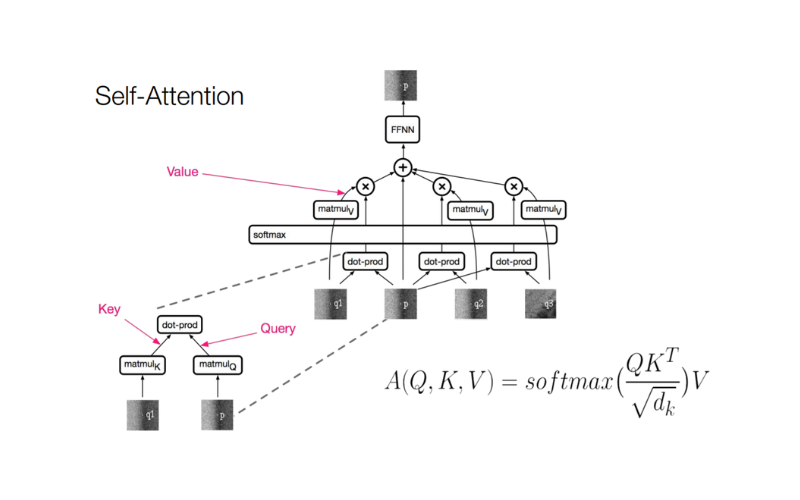

Kiến trúc Transformer bao gồm một lớp self-attention, nơi mà toàn bộ quá trình attention được tích hợp. Các bước được trình bày theo nghiên cứu gốc của Ashish Vaswani và cộng sự trong bài báo “Attention is All You Need”:

Bước 1: Mã hóa chuỗi đầu vào

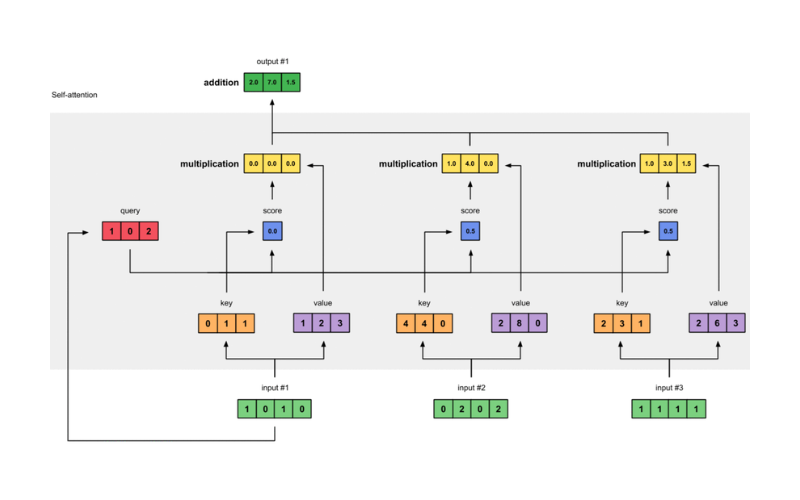

Chuỗi đầu vào được chuyển thành các vector (embedding) – tức là dạng biểu diễn số mà thuật toán học máy có thể sử dụng để tính toán điểm attention và tạo ra chuỗi đầu ra.

Trong bài toán dịch máy, một câu sẽ là chuỗi đầu vào, trong đó mỗi phần tử là một token (từ hoặc ký hiệu). Các token này được chuyển đổi thành embedding, hoạt động như những đơn vị ngữ nghĩa mà mô hình có thể xử lý. Embedding sẽ được dùng để tính toán trọng số attention, giúp mô hình xác định phần nào trong dữ liệu là quan trọng nhất.

Bước 2: Tạo các vector cho hàm attention

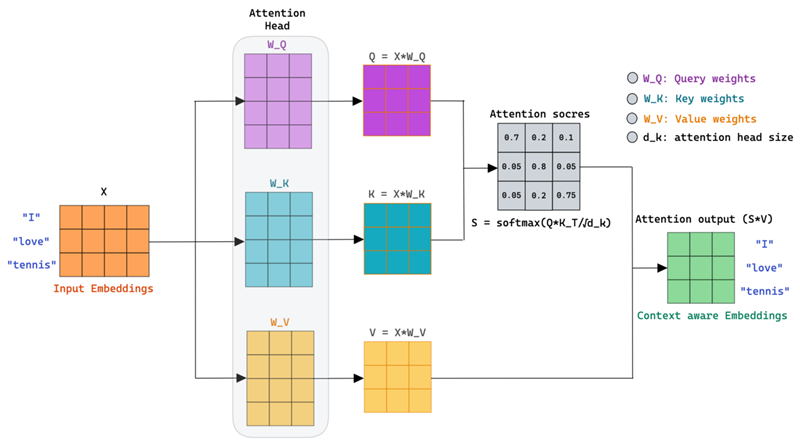

Mô hình sử dụng các embedding để tạo ra ba vector chính cho mỗi token: query (Q), key (K) và value (V). Ba thành phần này giúp mô hình xác định được các mối liên kết ngữ nghĩa chặt chẽ nhất trong chuỗi.

Việc tạo các vector Q, K và V được thực hiện thông qua nhân ma trận – một quá trình gọi là biến đổi tuyến tính (linear transformation), trong đó embedding đầu vào được nhân với các trọng số tương ứng.

Bước 3: Tính toán điểm attention

Sau khi embedding được biến đổi, mô hình tính điểm attention cho từng phần tử trong chuỗi. Điểm attention được tính bằng tích vô hướng (dot product) giữa các vector query và key, sau đó được chuẩn hóa bằng cách chia cho căn bậc hai của kích thước vector key. Cách làm này giúp ổn định gradient và tránh các giá trị quá lớn khi làm việc với vector có kích thước lớn.

Bước 4: Biến đổi điểm attention thành xác suất

Các điểm attention vừa tính sẽ được đưa qua hàm softmax để chuyển thành xác suất. Quá trình này gọi là chuẩn hóa (normalization).

Nhờ đó, kiến trúc transformer có thể đánh giá được tầm quan trọng tương đối của từng phần tử trong chuỗi khi tạo ra đầu ra. Các xác suất này đại diện cho mức độ ưu tiên mà mô hình nên dành cho từng phần tử.

Bước 5: Tạo tổng có trọng số của vector value

Trọng số attention sau chuẩn hóa sẽ được dùng để tính tổng có trọng số của các vector value. Trọng số càng cao, phần tử đó sẽ càng ảnh hưởng nhiều hơn đến đầu ra cuối cùng của mô hình. Nói cách khác, đầu ra là một tổng hợp tập trung, được điều chỉnh theo mức độ quan trọng của từng phần tử trong chuỗi đầu vào.

Lợi ích của Self-Attention mang lại

Để hiểu hơn về Self-Attention là gì, hãy cùng khám phá xem nó mang lại những lợi ích gì nhé! Self-attention (tự chú ý) mang lại nhiều lợi ích quan trọng trong học máy và trí tuệ nhân tạo như:

Phụ thuộc dài hạn

Self-attention giúp mô hình nhận biết mối quan hệ giữa các phần tử cách xa nhau trong chuỗi đầu vào, từ đó hiểu được các mẫu phức tạp và các mối liên kết có tính dài hạn.

Hiểu ngữ cảnh

Bằng cách “chú ý” đến các phần khác nhau của chuỗi đầu vào, self-attention giúp mô hình nắm bắt ngữ cảnh tổng thể và phân bổ trọng số phù hợp cho từng phần tử dựa trên mức độ liên quan.

Tính toán song song

Self-attention có thể được xử lý song song cho từng phần tử trong chuỗi, giúp tăng hiệu suất tính toán và khả năng mở rộng khi làm việc với tập dữ liệu lớn.

Khả năng mở rộng quy mô

Một trong những ưu thế cốt lõi của Self-Attention chính là khả năng mở rộng linh hoạt. Kỹ thuật này cho phép mô hình làm việc hiệu quả với các chuỗi dữ liệu có độ dài thay đổi và đồng thời học được các mối liên hệ giữa các yếu tố cách xa nhau.

Đặc điểm này tạo điều kiện để Self-Attention có thể được triển khai trong nhiều lĩnh vực ứng dụng khác nhau, từ ngôn ngữ tự nhiên, xử lý hình ảnh cho đến phân tích và sáng tạo âm nhạc.

Hiệu quả tính toán

Các mô hình ứng dụng Self-Attention sở hữu hiệu quả tính toán cao. Do bản chất của cơ chế này, các phép toán liên quan đến Self-Attention có thể được thực thi song song trên nhiều đơn vị xử lý, và độ phức tạp tính toán của chúng thường tăng tuyến tính theo độ dài chuỗi đầu vào. Điều này giúp rút ngắn đáng kể thời gian huấn luyện mô hình và nâng cao hiệu suất tổng thể.

Khả năng học hỏi mạnh mẽ

Mô hình Self-Attention có khả năng tự học hỏi rất tốt. Nhờ vào cấu trúc được tổ chức một cách nhất quán và cơ chế Attention tập trung vào thông tin quan trọng, mô hình này có thể học được các biểu diễn dữ liệu phức tạp và mô hình hóa chính xác các mối phụ thuộc xa.

Điều này cho phép mô hình tự động trích xuất những đặc trưng có ý nghĩa từ dữ liệu và qua đó cải thiện chất lượng kết quả cho bài toán đang giải quyết.

Tính linh hoạt cao

Self-Attention thể hiện tính linh hoạt đáng kể. Với cấu trúc tổ chức đồng nhất và cơ chế Attention cốt lõi, các mô hình dựa trên Self-Attention có thể dễ dàng được điều chỉnh, mở rộng và tùy biến để phù hợp với nhiều bài toán và ứng dụng đa dạng.

Từ xử lý ngôn ngữ, hình ảnh cho đến âm nhạc, Self-Attention đang ngày càng khẳng định tiềm năng sáng tạo to lớn và phạm vi ứng dụng rộng khắp của mình.

Các lĩnh vực ứng dụng của Self-Attention

Trong xử lý ngôn ngữ tự nhiên (NLP)

Cơ chế Self-Attention đã minh chứng rõ ràng năng lực của mình trong lĩnh vực xử lý ngôn ngữ tự nhiên. Nhờ vào khả năng đặc biệt trong việc học các mối phụ thuộc ở khoảng cách xa, những mô hình tích hợp Self-Attention có thể xử lý hiệu quả các loại dữ liệu đầu vào với độ dài không cố định, chẳng hạn như các câu hoặc toàn bộ văn bản.

Một trong những ứng dụng nổi bật và thành công nhất của Self-Attention trong mảng ngôn ngữ chính là mô hình Transformer, đặc biệt là trong bài toán dịch máy (machine translation).

Sự ra đời của Transformer đã tạo ra bước nhảy vọt về hiệu suất dịch thuật cũng như khả năng hiểu sâu sắc các biểu đạt phức tạp của ngôn ngữ.

Trong xử lý hình ảnh

Self-Attention cũng đã tìm thấy những ứng dụng thành công trong lĩnh vực xử lý hình ảnh. Cấu trúc Attention Đa đầu (Multi-Head Attention), một thành phần quan trọng trong mô hình Transformer, cho phép mô hình tập trung hiệu quả vào các vùng thông tin then chốt bên trong một bức ảnh và học được các biểu diễn hình ảnh đa dạng, phong phú hơn.

Một ứng dụng đáng chú ý của Self-Attention trong xử lý ảnh là trong việc tạo sinh hình ảnh (image generation). Các mô hình dựa trên Transformer đã cho thấy những kết quả hết sức ấn tượng, có khả năng tạo ra những hình ảnh mới với chất lượng cao và độ đa dạng đáng kinh ngạc.

Trong xử lý âm nhạc

Công nghệ âm nhạc cũng là một lĩnh vực mà Self-Attention đã được áp dụng thành công. Tương tự như trong xử lý ảnh, cơ chế Attention Đa đầu trong các mô hình như Transformer giúp mô hình học được các mối liên hệ và cấu trúc phức tạp, kể cả ở khoảng cách xa, trong việc sáng tạo âm nhạc.

Mô hình Transformer đã được khai thác để tự động tạo ra các sản phẩm âm nhạc, từ việc hoàn thiện những đoạn nhạc còn dang dở cho đến việc sáng tác hoàn chỉnh các bản nhạc mang tính nghệ thuật.

Những ứng dụng này không chỉ mang lại kết quả đáng khích lệ mà còn mở ra vô vàn tiềm năng sáng tạo mới cho ngành công nghiệp âm nhạc.

Self-Attention đã và đang mở ra những khả năng mới cho trí tuệ nhân tạo, từ xử lý ngôn ngữ đến hình ảnh và sáng tạo âm nhạc. Nhờ vào khả năng học sâu các mối liên kết dài hạn, xử lý song song và mở rộng quy mô linh hoạt, cơ chế này đã trở thành xương sống của các kiến trúc hiện đại như Transformer.

Trong tương lai, Self-Attention hứa hẹn sẽ tiếp tục phát triển mạnh mẽ, đóng vai trò trung tâm trong những bước tiến đột phá của công nghệ AI đa lĩnh vực.

Việc triển khai các mô hình AI sử dụng Self-Attention đòi hỏi hạ tầng máy chủ mạnh mẽ và ổn định. Dịch vụ thuê VPS chất lượng cao giá tốt tại InterData sử dụng CPU AMD EPYC hoặc Intel Xeon Platinum, ổ cứng SSD NVMe U.2, cùng băng thông cao và cấu hình tối ưu. Đây là lựa chọn phù hợp để xử lý tác vụ AI, học máy hoặc vận hành hệ thống web hiệu suất cao.

Nếu bạn cần nền tảng linh hoạt hơn để mở rộng quy mô xử lý, InterData cung cấp dịch vụ thuê Cloud Server giá rẻ tốc độ cao giúp bạn triển khai các mô hình học sâu trên môi trường ảo hóa tiên tiến. Máy chủ hoạt động ổn định, dễ tùy chỉnh, đáp ứng yêu cầu tính toán lớn mà vẫn tối ưu chi phí vận hành.

INTERDATA

- Website: Interdata.vn

- Hotline: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh