Naive Bayes là một trong những thuật toán phân loại đơn giản, nhanh chóng và dễ triển khai nhất trong lĩnh vực học máy. Dù dựa trên giả định “ngây thơ” về tính độc lập giữa các đặc trưng, Naive Bayes vẫn mang lại hiệu quả bất ngờ trong nhiều ứng dụng thực tế như phân loại văn bản, lọc thư rác hay phân tích cảm xúc. Bài viết dưới đây sẽ giúp bạn hiểu rõ hơn Naive Bayes là gì, cách hoạt động, so sánh Naive Bayes với các thuật toán khác và các trường hợp ứng dụng nổi bật.

Naive Bayes là gì?

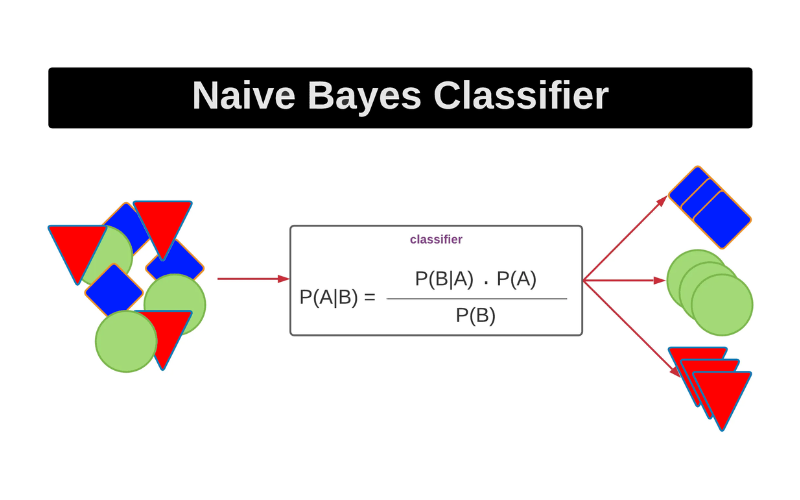

Naive Bayes là một thuật toán học có giám sát (supervised learning) được sử dụng trong các bài toán phân loại, ví dụ như phân loại văn bản. Thuật toán này áp dụng các nguyên lý xác suất để thực hiện việc phân loại dữ liệu.

Naive Bayes thuộc nhóm thuật toán học sinh (generative learning algorithms), tức là nó cố gắng mô hình hóa phân phối đầu vào của từng lớp dữ liệu. Khác với các bộ phân loại phân biệt (discriminative classifiers) như hồi quy logistic, Naive Bayes không học để xác định đặc trưng nào là quan trọng nhất nhằm phân biệt giữa các lớp.

Các đặc điểm chính của bộ phân loại Naive Bayes

Ý tưởng cốt lõi của bộ phân loại Naive Bayes là sử dụng định lý Bayes để phân loại dữ liệu dựa trên xác suất của các lớp khác nhau, được tính từ các đặc trưng đầu vào của dữ liệu. Naive Bayes thường được ứng dụng chủ yếu trong các bài toán phân loại văn bản có số chiều cao.

Naive Bayes là một bộ phân loại đơn giản dựa trên xác suất, với số lượng tham số rất ít so với các thuật toán phân loại khác. Nhờ đó, các mô hình học máy được xây dựng từ Naive Bayes có khả năng dự đoán nhanh hơn.

Thuật toán này được gọi là bộ phân loại xác suất (probabilistic classifier) vì nó giả định rằng mỗi đặc trưng trong mô hình là độc lập với sự tồn tại của các đặc trưng còn lại. Nói cách khác, mỗi đặc trưng đóng góp vào kết quả dự đoán một cách độc lập, không có mối liên hệ nào với nhau.

Naive Bayes được sử dụng rộng rãi trong nhiều lĩnh vực như: lọc thư rác, phân tích cảm xúc, phân loại bài viết và nhiều ứng dụng khác.

Các loại bộ phân loại Naive Bayes

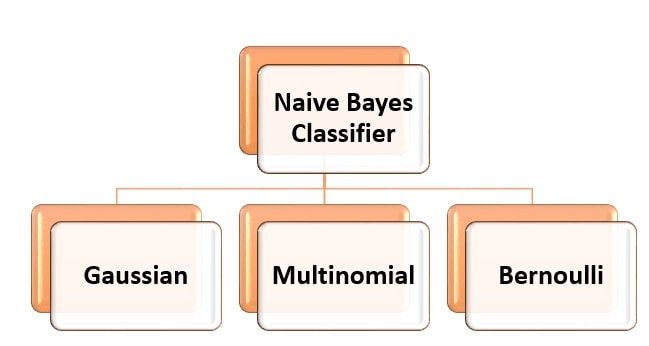

Không chỉ có một phiên bản duy nhất, Naive Bayes có nhiều biến thể phổ biến khác nhau dựa trên cách phân phối của các giá trị đặc trưng. Có ba loại mô hình Naive Bayes phổ biến nhất:

Gaussian Naive Bayes

Trong Gaussian Naive Bayes, các giá trị liên tục của đặc trưng được giả định phân phối theo phân phối Gaussian (hay còn gọi là phân phối chuẩn – Normal distribution). Khi biểu diễn bằng đồ thị, phân phối này có hình dạng chuông đối xứng quanh giá trị trung bình của đặc trưng.

Multinomial Naive Bayes

Multinomial Naive Bayes được sử dụng khi các đặc trưng đại diện cho tần suất xuất hiện của các thuật ngữ (như số lần một từ xuất hiện trong tài liệu). Đây là mô hình thường được áp dụng trong phân loại văn bản, nơi mà tần suất từ ngữ có vai trò quan trọng.

Bernoulli Naive Bayes

Bernoulli Naive Bayes xử lý các đặc trưng nhị phân (binary), nơi mỗi đặc trưng cho biết một từ có xuất hiện hay không trong tài liệu. Mô hình này phù hợp với các tình huống mà sự hiện diện hay vắng mặt của từ quan trọng hơn tần suất xuất hiện. Cả hai mô hình Multinomial và Bernoulli đều được sử dụng phổ biến trong các tác vụ phân loại tài liệu.

Tất cả các biến thể trên đều có thể được triển khai bằng thư viện Python Scikit-learn (sklearn).

Ưu và nhược điểm của thuật toán Naive Bayes

Ưu điểm

- Đơn giản và dễ triển khai: So với nhiều thuật toán phân loại khác, Naive Bayes được xem là đơn giản hơn do quá trình ước lượng tham số dễ dàng. Đây là một trong những thuật toán đầu tiên được giảng dạy trong các khóa học khoa học dữ liệu và học máy.

- Tốc độ xử lý nhanh, dễ mở rộng: So với hồi quy logistic, Naive Bayes có tốc độ xử lý nhanh, hoạt động hiệu quả khi giả định độc lập có điều kiện (conditional independence) được đảm bảo. Ngoài ra, nó yêu cầu ít dung lượng lưu trữ.

- Xử lý tốt dữ liệu nhiều chiều: Trong các bài toán như phân loại tài liệu, dữ liệu thường có số chiều rất lớn – điều mà nhiều thuật toán khác gặp khó khăn, nhưng Naive Bayes vẫn xử lý tốt.

- Hiệu quả trong các bài toán có số lượng đặc trưng lớn.

- Vẫn hoạt động tốt ngay cả khi dữ liệu huấn luyện bị giới hạn.

- Xử lý hiệu quả với các đặc trưng dạng phân loại (categorical features).

- Với các đặc trưng dạng số (numerical features), thuật toán giả định dữ liệu tuân theo phân phối chuẩn (normal distribution).

Nhược điểm

- Vấn đề tần suất bằng 0 (Zero Frequency): Xảy ra khi một giá trị hạng mục không tồn tại trong tập huấn luyện. Ví dụ, nếu từ “sir” không có trong dữ liệu huấn luyện nhưng lại xuất hiện trong email mới cần phân loại là “spam”, xác suất sẽ bằng 0. Do thuật toán nhân tất cả các xác suất có điều kiện lại với nhau, xác suất hậu nghiệm (posterior) cũng sẽ bằng 0. Giải pháp là dùng Laplace smoothing để khắc phục.

- Giả định cốt lõi không thực tế: Giả định rằng các đặc trưng độc lập với nhau có thể không đúng trong nhiều trường hợp thực tế, dẫn đến kết quả phân loại sai.

So sánh Naive Bayes với các thuật toán phân loại khác

Khi so sánh Naive Bayes với các thuật toán phân loại khác, có nhiều yếu tố cần được xem xét. Để hiểu hơn về Naive Bayes là gì, hãy cùng so sánh nó với các thuật toán khác ngay dưới đât.

Hồi quy logistic

Hồi quy logistic là lựa chọn hàng đầu cho các bài toán phân loại nhị phân. Khi các đặc trưng không độc lập với nhau, hồi quy logistic thường cho kết quả tốt hơn Naive Bayes.

Tuy vậy, Naive Bayes lại đơn giản hơn và có tốc độ triển khai nhanh hơn. Trong các bài toán phân loại tin tức, Naive Bayes đã đạt kết quả ấn tượng với độ chính xác khoảng 74% ngay cả khi áp dụng các phương pháp đơn giản.

Cây quyết định (Decision Trees)

Cây quyết định (Decision Trees) nổi bật với khả năng dễ diễn giải và xử lý tốt các mối quan hệ phức tạp giữa các đặc trưng. Mô hình này hoạt động hiệu quả với số lượng lớp nhỏ và có thể xử lý dữ liệu thiếu.

Tuy nhiên, trong các lĩnh vực như robot học và thị giác máy tính, Naive Bayes lại thường vượt trội hơn. Đối với các hiện tượng hiếm gặp, cả Naive Bayes và k-Nearest Neighbors (k-NN) đều có thể hoạt động tốt hơn cây quyết định.

Support Vector Machines (SVM)

SVM thường rất mạnh trong phân loại văn bản nhưng lại tiêu tốn nhiều tài nguyên tính toán. Trong khi đó, Naive Bayes vẫn duy trì tính cạnh tranh nhờ sự đơn giản và tốc độ, đặc biệt là với các tập dữ liệu lớn.

Trong nhiều nghiên cứu so sánh thuật toán, Naive Bayes cho thấy độ chính xác đáng ghi nhận, đặc biệt là các biến thể như Multinomial Naive Bayes và Complement Naive Bayes, vốn được đánh giá cao trong phân loại tin tức.

Việc lựa chọn giữa Naive Bayes và các thuật toán phân loại khác phụ thuộc vào bài toán cụ thể, kích thước dữ liệu và nguồn lực tính toán. Dù các mô hình phức tạp hơn có thể mang lại hiệu suất tốt hơn trong một số trường hợp, nhưng Naive Bayes vẫn là một lựa chọn mạnh mẽ nhờ khả năng hoạt động hiệu quả và linh hoạt trong nhiều tình huống.

Các trường hợp ứng dụng phổ biến của Naive Bayes

Bộ phân loại Naïve Bayes được sử dụng rộng rãi trong nhiều lĩnh vực nhờ khả năng giải quyết các bài toán phân loại phức tạp một cách hiệu quả. Nhờ sự linh hoạt, đây là một trong những giải pháp ưu tiên trong nhiều ứng dụng thực tế.

- Phát hiện thư rác (Spam Detection): Naïve Bayes được tích hợp vào các hệ thống email để lọc các tin nhắn không mong muốn. Thuật toán phân tích các mẫu nội dung của email để xác định email nào là spam.

- Phân tích cảm xúc (Sentiment Analysis): Doanh nghiệp sử dụng Naïve Bayes để phân tích phản hồi của khách hàng từ đánh giá hoặc mạng xã hội. Việc này giúp họ cải thiện sản phẩm và dịch vụ.

- Phân loại tài liệu (Document Classification): Các cơ quan báo chí sử dụng Naïve Bayes để tự động phân loại bài viết theo chủ đề, giúp tối ưu quy trình quản lý nội dung và nâng cao trải nghiệm người đọc.

- Hỗ trợ chẩn đoán y tế: Trong y tế, Naïve Bayes được dùng để hỗ trợ bác sĩ dự đoán bệnh dựa trên triệu chứng và dữ liệu bệnh nhân, góp phần nâng cao độ chính xác trong chẩn đoán.

- Dự đoán trong thời gian thực: Nhờ tốc độ xử lý nhanh chóng, Bộ phân loại Naïve Bayes (NBC) rất phù hợp để triển khai trong các hệ thống yêu cầu phản hồi tức thì, ví dụ như các hệ thống cảnh báo sớm hoặc phát hiện sự cố theo thời gian thực.

- Dự đoán đa lớp (Multi-class Prediction): Thuật toán này, thông qua việc áp dụng định lý Bayes mở rộng, cho phép xây dựng các ứng dụng có khả năng dự đoán đồng thời nhiều giả thuyết hoặc kết quả mục tiêu khác nhau, thay vì chỉ giới hạn ở hai lớp.

- Hệ thống gợi ý (Recommendation System): Bộ phân loại Naïve Bayes là một công cụ được sử dụng phổ biến và rộng rãi trong quá trình xây dựng và phát triển các hệ thống gợi ý sản phẩm hoặc nội dung cho người dùng.

Các câu hỏi thường gặp về Naive Bayes

Ví dụ thực tế của Naive Bayes là gì?

Naive Bayes là một bộ phân loại xác suất đơn giản dựa trên định lý Bayes. Thuật toán này giả định rằng các đặc trưng của điểm dữ liệu là độc lập với nhau – điều này thường không đúng trong thực tế. Tuy nhiên, dù có giả định đơn giản này, Naive Bayes vẫn cho thấy hiệu quả ấn tượng trong nhiều ứng dụng khác nhau.

Tại sao thuật toán này được gọi là “Naive Bayes”?

Naive Bayes được gọi là “naive” vì nó giả định rằng tất cả các đặc trưng của một điểm dữ liệu đều độc lập với nhau. Giả định này thường không đúng trong thực tế, nhưng nó giúp thuật toán đơn giản hơn và dễ tính toán hơn rất nhiều.

Thuật toán nào tốt hơn Naive Bayes?

Có nhiều bộ phân loại khác có thể hoạt động tốt hơn Naive Bayes trong một số tình huống nhất định. Ví dụ, hồi quy logistic (logistic regression) thường cho kết quả chính xác hơn, đặc biệt là khi các đặc trưng của dữ liệu có sự liên hệ chặt chẽ với nhau (tức là không độc lập).

Vấn đề tần suất bằng 0 (Zero Frequency) trong bộ phân loại Naive Bayes là gì?

Vấn đề Zero Frequency xảy ra khi một biến phân loại trong dữ liệu kiểm tra không xuất hiện trong tập dữ liệu huấn luyện. Kết quả là xác suất của biến đó bằng 0. Để khắc phục vấn đề này, người ta sử dụng kỹ thuật làm trơn Laplace (Laplace Smoothing).

Xác suất trong Naive Bayes có thể lớn hơn 1 không?

Không. Xác suất của một sự kiện không thể lớn hơn 1. Xác suất là một giá trị nằm trong khoảng từ 0 đến 1, trong đó 0 nghĩa là sự kiện không thể xảy ra, và 1 là sự kiện chắc chắn xảy ra.

Naive Bayes không chỉ đơn giản về mặt kỹ thuật mà còn hiệu quả vượt mong đợi trong nhiều lĩnh vực ứng dụng thực tế. Dù tồn tại những hạn chế nhất định, thuật toán này vẫn là lựa chọn lý tưởng cho các bài toán phân loại có số chiều lớn hoặc dữ liệu giới hạn.

Việc hiểu rõ ưu – nhược điểm của Naive Bayes là gì sẽ giúp bạn chọn được thuật toán phù hợp nhất với bài toán của mình. Trong bối cảnh các hệ thống ngày càng yêu cầu phản hồi nhanh và chi phí tối ưu, Naive Bayes xứng đáng có mặt trong bộ công cụ của bất kỳ ai làm việc với dữ liệu và học máy.

Để triển khai các mô hình học máy như Naive Bayes hiệu quả hơn, bạn có thể lựa chọn thuê VPS chất lượng cao giá tốt tại InterData. Với hạ tầng hiện đại sử dụng CPU AMD EPYC hoặc Intel Xeon Platinum, kết hợp cùng ổ SSD NVMe U.2 và băng thông lớn, dịch vụ này phù hợp cho cả mô hình phân loại thời gian thực lẫn phân tích dữ liệu quy mô vừa và nhỏ.

Nếu bạn cần khả năng mở rộng linh hoạt hơn cho dự án AI, phân loại văn bản hoặc hệ thống gợi ý, thuê Cloud Server giá rẻ tốc độ cao là giải pháp đáng cân nhắc. Cloud Server của InterData được tối ưu dung lượng, vận hành ổn định và phù hợp cho các thuật toán học máy có tải lớn, giúp bạn triển khai nhanh – tiết kiệm – hiệu quả.

Hãy liên hệ ngay để được tư vấn giải pháp phù hợp với nhu cầu của bạn!

INTERDATA

- Website: Interdata.vn

- Hotline: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh