Model Deployment (Triển khai mô hình) là một phần quan trọng trong quá trình phát triển mô hình học máy. Nó không chỉ giúp đưa các mô hình học máy vào ứng dụng thực tế mà còn đảm bảo mô hình có thể cung cấp dự đoán chính xác và kịp thời cho người dùng hoặc các hệ thống. Bài viết này sẽ giúp bạn hiểu rõ Model Deployment là gì? Các tiêu chí và thách thức khi triển khai mô hình học máy, cũng như các công cụ và kỹ thuật hỗ trợ quá trình triển khai để đạt được hiệu quả cao nhất. Đọc ngay!

Model Deployment là gì?

Model Deployment (Triển khai mô hình) là quá trình đưa các mô hình học máy vào sản xuất. Quá trình này giúp các dự đoán của mô hình có thể được sử dụng bởi người dùng, nhà phát triển hoặc các hệ thống, từ đó họ có thể đưa ra quyết định kinh doanh dựa trên dữ liệu, tương tác với ứng dụng của họ (như nhận diện khuôn mặt trong ảnh), v.v.

Triển khai mô hình được xem là một giai đoạn đầy thách thức đối với các nhà khoa học dữ liệu. Điều này xảy ra vì đây thường không phải là trách nhiệm chính của họ, cùng với sự khác biệt về công nghệ và tư duy giữa việc phát triển và huấn luyện mô hình và các công nghệ tổ chức, như phiên bản, kiểm tra và mở rộng quy mô, làm cho việc triển khai trở nên khó khăn.

Những vấn đề về tổ chức và công nghệ này có thể được giải quyết bằng cách sử dụng các khuôn khổ, công cụ và quy trình triển khai mô hình phù hợp.

Tầm quan trọng của Model Deployment

Chỉ các mô hình được triển khai vào sản xuất mới mang lại giá trị kinh doanh cho khách hàng và người dùng. Theo các phân tích khác nhau, từ 60%-90% các mô hình không được đưa vào sản xuất.

Việc triển khai các mô hình học máy giúp chúng có sẵn để phục vụ cho việc ra quyết định, dự đoán và cung cấp những thông tin chi tiết, tùy thuộc vào sản phẩm cuối cùng.

Ví dụ, giả sử một nhà khoa học dữ liệu đã xây dựng một mô hình phân tích cảm xúc trên các bình luận YouTube. Sau khi xây dựng, gỡ lỗi và huấn luyện mô hình, mô hình đạt được điểm số chính xác xuất sắc và nhà khoa học dữ liệu hài lòng với kết quả.

Mặc dù điểm số chính xác cao là một điều tuyệt vời, nhưng khi mô hình chỉ nằm trong môi trường nghiên cứu, giá trị của nó chỉ là lý thuyết và không thể được kiểm tra trên dữ liệu thực tế (nơi nó có thể hoạt động khác đi).

Vì vậy, ngay cả khi nó là mô hình phân tích ngôn ngữ tự nhiên (NLP) tốt nhất trên thế giới, mô hình chỉ thực sự mang lại giá trị khi nó đã được kiểm tra và triển khai vào sản xuất, nơi nó có thể phân tích dữ liệu thực tế.

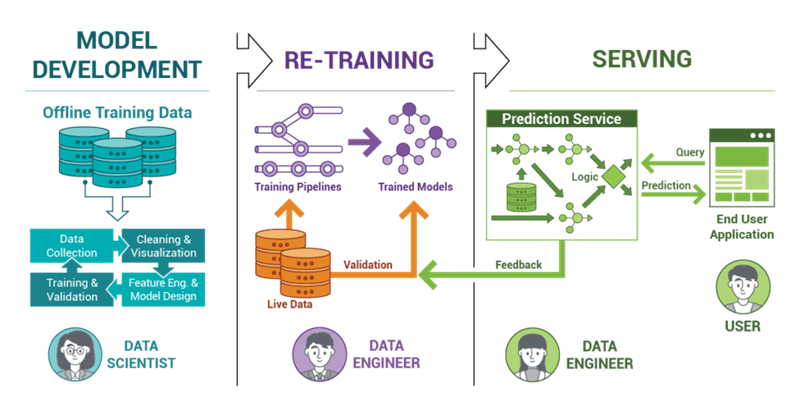

Model Deployment trong học máy hoạt động như thế nào?

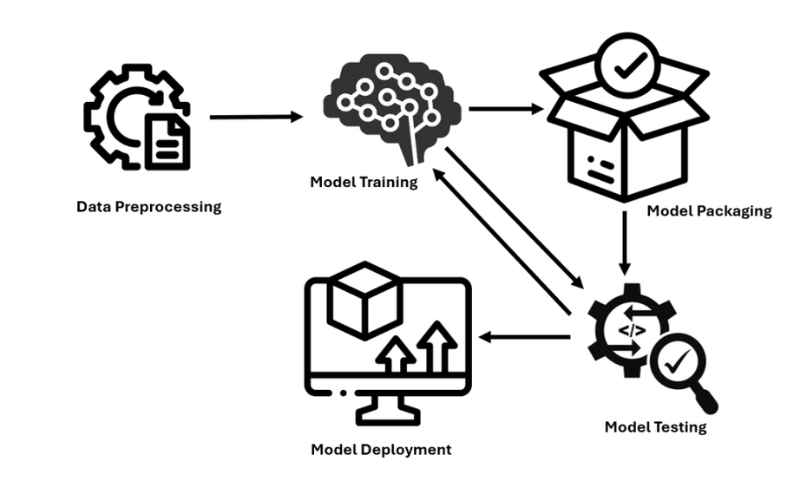

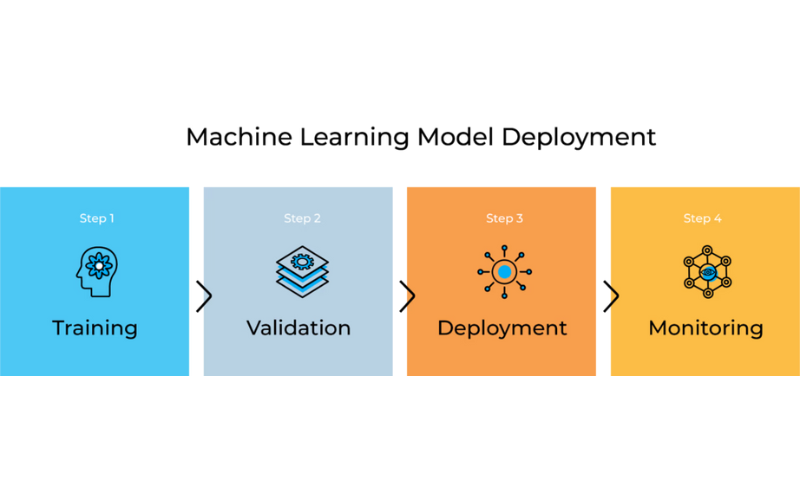

Các bước triển khai mô hình có thể thay đổi tùy theo các yếu tố như mô hình được sử dụng như thế nào và loại môi trường nào cần thiết để lưu trữ nó. Tuy nhiên, quá trình triển khai mô hình học máy nói chung có thể tóm gọn trong các hoạt động chính sau:

- Chọn môi trường sản xuất: Các kỹ sư chọn môi trường phù hợp để triển khai mô hình vào sản xuất. Để đưa ra quyết định đúng đắn, họ cần xem xét các yếu tố như mô hình có yêu cầu phần cứng chuyên dụng hay không, cơ sở hạ tầng lưu trữ cần phải có khả năng mở rộng như thế nào để đáp ứng sự thay đổi trong việc sử dụng mô hình, và mức độ trễ của mô hình có thể chấp nhận được không.

- Di chuyển lớp dữ liệu mô hình: Các mô hình học máy thường yêu cầu tài nguyên dữ liệu có sẵn trong môi trường sản xuất để hỗ trợ việc suy luận. Nếu lớp dữ liệu tách rời khỏi mô hình, dữ liệu có thể được triển khai riêng biệt với mô hình.

- Triển khai mô hình: Ngoài việc sao chép mô hình vào sản xuất, đội ngũ còn có thể di chuyển chính mô hình vào hệ thống sản xuất.

- Cung cấp mô hình: Như đã đề cập ở trên, việc cung cấp mô hình là cần thiết bằng cách phơi bày nó qua API hoặc dịch vụ Web để người dùng có thể tương tác với mô hình.

Để đơn giản hóa quá trình di chuyển và giảm thiểu nguy cơ lỗi do các vấn đề như chuyển dữ liệu không đầy đủ, các nhóm có thể đóng gói mô hình sử dụng công nghệ như containers. Containers rất hữu ích trong bối cảnh triển khai mô hình (cũng như triển khai phần mềm nói chung) vì chúng cung cấp một cách nhất quán để đóng gói và chạy mô hình.

Điều này có nghĩa là sự khác biệt giữa môi trường huấn luyện và kiểm tra mô hình và môi trường sản xuất ít có khả năng gây ra hành vi bất ngờ. Nếu mô hình chạy dưới dạng container trong cả môi trường kiểm tra và môi trường sản xuất, nó sẽ hoạt động nhất quán ở cả hai môi trường.

Các tiêu chí Model Deployment

Trước khi triển khai một mô hình, có một vài tiêu chí mà mô hình học máy của bạn cần đạt được để sẵn sàng cho việc triển khai:

- Khả năng di động: Đây là khả năng của phần mềm để chuyển từ máy này sang máy khác hoặc từ hệ thống này sang hệ thống khác. Một mô hình có khả năng di động là một mô hình có thời gian phản hồi tương đối thấp và có thể được viết lại với ít nỗ lực.

- Khả năng mở rộng: Đây là khả năng mở rộng quy mô của mô hình. Một mô hình có khả năng mở rộng là một mô hình không cần phải thiết kế lại để duy trì hiệu suất.

Tất cả các tiêu chí trên sẽ diễn ra trong một môi trường sản xuất, là thuật ngữ dùng để mô tả môi trường nơi phần mềm và các sản phẩm khác được đưa vào vận hành thực tế phục vụ cho người dùng cuối.

4 yếu tố cần xem xét khi triển khai mô hình

Có một số yếu tố và tác động mà bạn cần xem xét khi quyết định cách triển khai mô hình học máy. Các yếu tố này bao gồm:

- Tần suất dự đoán sẽ được tạo ra và mức độ khẩn cấp của kết quả.

- Liệu dự đoán có nên được tạo ra riêng lẻ hay theo lô.

- Các yêu cầu về độ trễ của mô hình, khả năng tính toán mà bạn có và các yêu cầu về mức độ dịch vụ (SLA).

- Các tác động và chi phí vận hành cần thiết để triển khai và duy trì mô hình.

Hiểu rõ các yếu tố này sẽ giúp bạn đưa ra quyết định giữa các phương pháp triển khai mô hình như triển khai một lần, theo lô hoặc thời gian thực.

Những thách thức khi Model Deployment

Có một số lý do khiến việc triển khai mô hình trở thành một quá trình đòi hỏi tài nguyên và đầy thách thức:

- Vấn đề phân tách (Silos): Các nhà khoa học dữ liệu thường chỉ tập trung vào việc huấn luyện và tối ưu hóa các mô hình. Trong nhiều tổ chức, khoa học dữ liệu bị tách biệt với phần còn lại của vòng đời học máy. Cách tiếp cận “ném qua tường” nổi tiếng gây ra các tắc nghẽn, công việc trùng lặp và sự hỗn loạn chung. Hệ thống sản xuất, được quản lý và duy trì bởi DevOps và IT, thường không quen thuộc với các khuôn khổ học máy và các tập tin mô hình mà các nhà khoa học dữ liệu đã xây dựng và sản xuất. Trong một số trường hợp, mô hình cần phải được mã hóa lại, điều này có thể mất vài tuần và là một quá trình rất tốn thời gian.

- Chuẩn bị cho môi trường thực tế: Trong phòng thí nghiệm, các mô hình được phát triển và huấn luyện dựa trên dữ liệu hiện có. Tuy nhiên, trong môi trường sản xuất, mô hình sẽ phải làm việc với dữ liệu thực tế (thậm chí là dữ liệu thời gian thực) từ các nguồn bên ngoài. Thông thường, dữ liệu cần được xử lý trước khi được đưa vào mô hình. Sau đó, đầu ra và các dự đoán cần phải được ứng dụng tiêu thụ đúng cách. Những quy trình này cần được chuẩn bị và phối hợp để đảm bảo triển khai thành công và suôn sẻ.

- Giám sát các mô hình trong môi trường sản xuất: Việc triển khai không kết thúc khi mô hình đã vào sản xuất. Ngày nay, các mô hình luôn thay đổi do nhu cầu kinh doanh thay đổi, dữ liệu thay đổi hoặc thậm chí là các trường hợp sử dụng mô hình thay đổi. Để đảm bảo mô hình vẫn có liên quan và mang lại giá trị kinh doanh trong hiệu suất, các mô hình trong môi trường sản xuất cần phải được đánh giá và theo dõi khi nào mô hình không còn hoạt động hiệu quả, để chúng có thể được huấn luyện lại và triển khai lại.

- Quản lý hạ tầng: Một lượng dữ liệu nhỏ không yêu cầu 8 GPU để suy luận, nhưng lưu lượng trong giờ cao điểm lại đòi hỏi nhiều tài nguyên tính toán để đảm bảo hiệu suất cao. Quản lý điều này đòi hỏi các quy trình và công cụ phù hợp.

Các công cụ Model Deployment học máy

Các công cụ triển khai mô hình học máy cung cấp các tính năng mạnh mẽ giúp đơn giản hóa quá trình triển khai, cho phép các tổ chức tích hợp hiệu quả các mô hình đã được huấn luyện vào hệ thống sản xuất và tận dụng lợi ích của học máy trong các ứng dụng thực tế.

Hãy cùng tìm hiểu một số công cụ triển khai mô hình học máy hàng đầu:

TensorFlow Serving

TensorFlow Serving là một công cụ mã nguồn mở phổ biến dùng để triển khai mô hình học máy trong sản xuất. Nó cung cấp kiến trúc linh hoạt để phục vụ các mô hình TensorFlow, cho phép suy luận hiệu quả và có hiệu suất cao. Nó cũng hỗ trợ cập nhật mô hình động, cho phép cập nhật và phiên bản hóa mà không làm gián đoạn quá trình phục vụ.

TensorFlow Serving thường được sử dụng trong các ngành công nghiệp như thương mại điện tử để cung cấp các đề xuất sản phẩm theo thời gian thực và phát hiện gian lận.

AWS SageMaker

Amazon SageMaker là một nền tảng AWS phổ biến để xây dựng, huấn luyện và triển khai các mô hình học máy. Nó cung cấp các công cụ và dịch vụ phong phú, bao gồm các thuật toán đã được xây dựng sẵn, khả năng tự động mở rộng và cơ sở hạ tầng được quản lý.

Một tính năng độc đáo của SageMaker là khả năng tự động tạo các điểm cuối của mô hình, cho phép triển khai mô hình dưới dạng các điểm cuối API để dự đoán theo thời gian thực một cách dễ dàng.

Nó được sử dụng phổ biến trong các quy trình triển khai mô hình học máy ở các lĩnh vực như chăm sóc sức khỏe để chẩn đoán bệnh từ hình ảnh y tế và tài chính để phát hiện gian lận và phân tích rủi ro.

Kubeflow

Kubeflow là một nền tảng mã nguồn mở giúp đơn giản hóa và tự động hóa quá trình triển khai mô hình học máy trên Kubernetes. Nó cung cấp một hệ sinh thái công cụ phong phú để quản lý và tự động hóa quy trình làm việc học máy từ đầu đến cuối.

Một đặc điểm độc đáo của Kubeflow là sự tập trung vào khả năng tái tạo, giúp người dùng theo dõi các thí nghiệm và phiên bản mô hình cũng như dễ dàng tái tạo kết quả. Kubeflow tận dụng khả năng mở rộng và khả năng phục hồi của Kubernetes, giúp triển khai mô hình một cách hiệu quả trên các cụm phân tán.

Kubeflow rất phù hợp cho các triển khai học máy quy mô lớn trong các ngành như tài chính cho giao dịch tần suất cao và sản xuất cho kiểm soát chất lượng và phát hiện bất thường.

MLFlow

MLFlow là một nền tảng mã nguồn mở giúp đơn giản hóa việc quản lý và triển khai các mô hình học máy. Nó cung cấp các công cụ để theo dõi thí nghiệm, tái tạo, đóng gói mô hình và triển khai.

Tính năng đặc biệt của MLFlow là hệ thống đăng ký mô hình, cho phép người dùng tổ chức, lưu trữ và quản lý các mô hình trong một kho lưu trữ tập trung. Điều này giúp dễ dàng hợp tác giữa các nhà khoa học dữ liệu và thúc đẩy phiên bản hóa và quản lý mô hình.

MLFlow hỗ trợ nhiều lựa chọn triển khai, bao gồm phục vụ mô hình dưới dạng API RESTful hoặc triển khai chúng trên các nền tảng đám mây như AWS hoặc Azure. Nó có ứng dụng trong nhiều lĩnh vực, chẳng hạn như trong chăm sóc sức khỏe để dự đoán kết quả của bệnh nhân và trong marketing để xây dựng hệ thống gợi ý cá nhân hóa.

Các cách thực hành Model Deployment học máy tốt nhất

Phần này đề cập đến một số thực tiễn tốt nhất bạn cần tuân thủ khi triển khai mô hình học máy để đảm bảo mô hình tiếp tục hoạt động hiệu quả trong các tình huống thực tế.

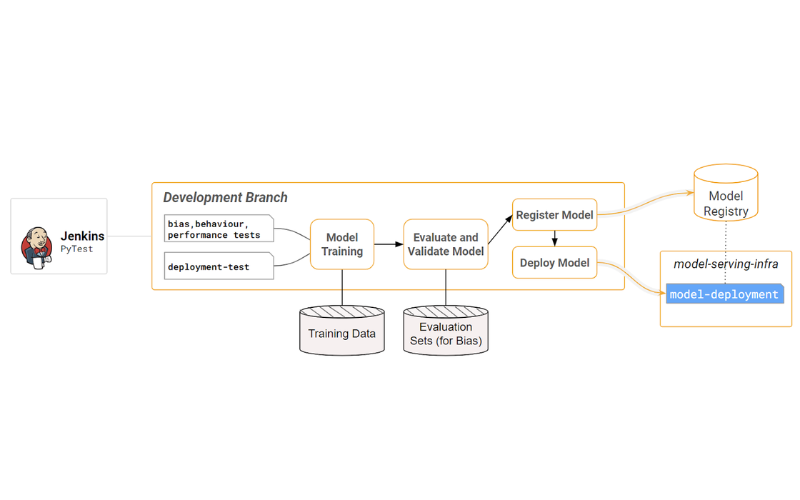

- Tích hợp và triển khai liên tục (CI/CD): Triển khai một quy trình CI/CD để cập nhật triển khai mô hình một cách liền mạch. Ví dụ, việc cập nhật mô hình thường xuyên trong xe tự lái có thể đảm bảo rằng phương tiện thích ứng với các điều kiện đường thay đổi và cải thiện độ an toàn.

Phiên bản và theo dõi – Duy trì hệ thống phiên bản vững chắc và theo dõi các thay đổi đối với mô hình và các phụ thuộc. Điều này giúp tuân thủ quy định, chẳng hạn như trong lĩnh vực chăm sóc sức khỏe, nơi theo dõi phiên bản mô hình và nguồn dữ liệu đảm bảo tính minh bạch và trách nhiệm. - Container hóa: Sử dụng công nghệ container hóa như Docker để đóng gói mô hình và các phụ thuộc của nó. Điều này giúp việc triển khai dễ dàng hơn trên các môi trường và nền tảng khác nhau. Cách này áp dụng cho việc triển khai mô hình bảo trì dự đoán trong sản xuất, nơi container giúp triển khai mô hình đồng nhất trên nhiều máy móc.

- Khả năng mở rộng và cân bằng tải: Đảm bảo kiến trúc triển khai có thể xử lý lưu lượng lớn và có thể mở rộng theo chiều ngang. Điều này rất hữu ích trong thương mại điện tử, nơi cân bằng tải cho phép mô hình xử lý nhiều đề xuất sản phẩm đồng thời trong mùa mua sắm cao điểm. Bạn có thể nghĩ về nó như một hàng thanh toán với nhiều thu ngân để khách hàng không phải chờ đợi lâu!

- Giám sát và cảnh báo: Triển khai các cơ chế giám sát và cảnh báo toàn diện để phát hiện và phản hồi khi mô hình giảm hiệu suất hoặc có bất thường. Trong lĩnh vực tài chính, cảnh báo giám sát thời gian thực có thể giúp phát hiện các mẫu gian lận tiềm ẩn và kích hoạt các hành động ngay lập tức để ngăn chặn gian lận.

Các kỹ thuật Model Deployment

Có nhiều kỹ thuật khác nhau để triển khai mô hình học máy, mỗi kỹ thuật có ưu điểm và trường hợp sử dụng riêng. Việc chọn chiến lược triển khai thường phụ thuộc vào yêu cầu cụ thể của ứng dụng, tính chất của dữ liệu và các đặc điểm về hiệu suất mong muốn.

Triển khai theo lô và thời gian thực

Trong triển khai theo lô, mô hình xử lý dữ liệu theo các lô (batch), thường là vào các khoảng thời gian đã được lên lịch hoặc khi có dữ liệu mới. Triển khai theo lô phù hợp với các ứng dụng mà dự đoán theo thời gian thực không phải là yếu tố quan trọng, chẳng hạn như xử lý theo lô dữ liệu lịch sử hoặc huấn luyện lại mô hình định kỳ.

Trong khi đó, triển khai thời gian thực liên quan đến việc phục vụ mô hình để cung cấp các dự đoán hoặc quyết định gần như ngay lập tức khi dữ liệu mới xuất hiện. Cách tiếp cận này là cần thiết cho các ứng dụng yêu cầu phản hồi với độ trễ thấp, chẳng hạn như hệ thống gợi ý, phát hiện gian lận hoặc phân tích thời gian thực.

Container hóa và Docker

Container hóa là một kỹ thuật phổ biến để triển khai mô hình học máy, vì nó đảm bảo các môi trường nhất quán và có thể tái tạo trên các nền tảng khác nhau.

Docker là một nền tảng container hóa phổ biến cho phép bạn đóng gói mô hình cùng với các phụ thuộc và cấu hình của nó vào một hình ảnh container di động. Cách tiếp cận này đơn giản hóa việc triển khai, thúc đẩy tính di động và hỗ trợ kiểm soát phiên bản và phục hồi.

Khung phục vụ mô hình

Các khung phục vụ mô hình là những công cụ chuyên dụng được thiết kế để đơn giản hóa việc triển khai và phục vụ mô hình học máy. Các giải pháp học máy của chúng tôi tích hợp liền mạch với các khung dữ liệu khoa học quan trọng như Apache Spark, cuPY, Dask và Numba, cũng như các khung học sâu phổ biến như PyTorch, TensorFlow và Apache MxNet.

Bạn có thể dễ dàng mở rộng từ một máy trạm lên các máy chủ đa GPU và các cụm máy chủ, đồng thời triển khai liền mạch trong môi trường sản xuất sử dụng Dask, Spark, MLFlow và Kubernetes.

Giám sát và ghi nhật ký

Giám sát bao gồm việc theo dõi các chỉ số và thông số khác nhau, như độ chính xác của dự đoán, thời gian phản hồi, mức sử dụng tài nguyên và tình trạng hệ thống.

Ngược lại, ghi nhật ký bao gồm việc ghi lại và lưu trữ thông tin liên quan đến hành vi của mô hình, đầu vào, đầu ra, và bất kỳ lỗi hoặc ngoại lệ nào xảy ra trong quá trình vận hành. Dữ liệu này có thể vô cùng hữu ích cho việc khắc phục sự cố, gỡ lỗi và kiểm toán.

Việc triển khai mô hình học máy đóng vai trò quan trọng trong việc tận dụng sức mạnh của các mô hình học máy để phục vụ cho các quyết định kinh doanh và ứng dụng thực tế. Hiểu rõ các kỹ thuật, công cụ và cách thực hành tốt nhất khi Model Deployment là gì sẽ giúp doanh nghiệp nâng cao hiệu suất và giảm thiểu rủi ro.

Để nâng cao chất lượng khi triển khai mô hình học máy cần một giải pháp lưu trữ mạnh mẽ với chi phí hợp lý, dịch vụ thuê VPS chất lượng giá rẻ tại InterData là lựa chọn lý tưởng. Sử dụng phần cứng thế hệ mới như CPU AMD EPYC và Intel Xeon Platinum, kết hợp với SSD NVMe U.2 và băng thông cao, dịch vụ VPS của chúng tôi cung cấp hiệu suất ổn định và tốc độ nhanh chóng cho các ứng dụng của bạn.

Đối với các doanh nghiệp hoặc cá nhân cần khả năng mở rộng linh hoạt và băng thông mạnh mẽ, thuê Cloud Server giá rẻ tốc độ cao tại InterData sẽ đáp ứng tốt nhu cầu của bạn. Cấu hình mạnh mẽ, dung lượng tối ưu và tốc độ cao từ phần cứng tiên tiến giúp việc triển khai mô hình học máy và các ứng dụng khác diễn ra suôn sẻ và hiệu quả. Liên hệ với chúng tôi để biết thêm chi tiết!

INTERDATA

- Website: Interdata.vn

- Hotline: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh

![Tham số (Parameter) là gì? Giải thích đầy đủ & Ví dụ [2025] 12 Tham số (Parameter)](https://interdata.vn/blog/wp-content/uploads/2025/04/Tham-so-Parameter-120x86.jpg)