Từ việc tự động lọc thư rác, chẩn đoán bệnh dựa trên hình ảnh y tế, đến việc phân loại khách hàng tiềm năng, các hệ thống phân loại (classification systems) đang hiện diện khắp nơi trong cuộc sống và công việc của chúng ta. Vậy, Classification là gì? Bài viết này sẽ cung cấp cho bạn một cái nhìn toàn diện về Classification.

Classification (Phân Loại) là gì?

Classification (phân loại) là một bài toán supervised learning (học có giám sát) trong machine learning, với mục tiêu dự đoán nhãn lớp (class label) rời rạc của một đối tượng dữ liệu dựa trên các đặc trưng (features) của đối tượng đó. Nói một cách đơn giản, đó là việc gán một đối tượng vào một trong các nhóm (lớp) đã được xác định trước.

Ví dụ, trong bài toán phân loại email, chúng ta muốn xác định xem một email là “spam” hay “không spam” (hai lớp). Các đặc trưng có thể là từ ngữ xuất hiện trong email, địa chỉ người gửi, tiêu đề email,… Mô hình classification sẽ học từ dữ liệu huấn luyện (các email đã được gán nhãn) để tìm ra mối quan hệ giữa các đặc trưng và nhãn lớp, từ đó dự đoán nhãn cho các email mới.

Các loại Classification

Binary Classification (Phân loại nhị phân)

Binary Classification là bài toán phân loại trong đó đối tượng dữ liệu chỉ có thể thuộc về một trong hai lớp. Hai lớp này thường được gọi là “positive” (lớp khẳng định) và “negative” (lớp phủ định), hoặc đơn giản là 0 và 1.

Đây là dạng phân loại phổ biến và cơ bản nhất. Nhiều bài toán thực tế có thể được đưa về dạng binary classification. Đôi khi, tôi thấy việc đơn giản hóa bài toán về dạng nhị phân lại mang lại hiệu quả bất ngờ, giúp mô hình tập trung vào việc phân biệt hai lớp quan trọng nhất.

Multiclass Classification (Phân loại đa lớp)

Multiclass Classification là bài toán phân loại trong đó đối tượng dữ liệu có thể thuộc về một trong nhiều hơn hai lớp. Các lớp này là loại trừ lẫn nhau (mutually exclusive), nghĩa là mỗi đối tượng chỉ thuộc về một lớp duy nhất.

Khác với binary classification chỉ có hai lựa chọn, multiclass classification mở ra một không gian rộng lớn hơn với nhiều khả năng hơn. Điều này đòi hỏi các thuật toán phải có khả năng phân biệt giữa nhiều lớp khác nhau, thường là phức tạp hơn.

Multi-label Classification (Phân loại đa nhãn)

Multi-label Classification là bài toán phân loại trong đó một đối tượng dữ liệu có thể thuộc về nhiều lớp cùng một lúc. Các lớp không loại trừ lẫn nhau.

Đây là dạng phân loại phức tạp nhất, phản ánh đúng thực tế khi một đối tượng thường có nhiều thuộc tính, nhiều khía cạnh khác nhau. Nó đòi hỏi các thuật toán phải có khả năng “nhìn” đối tượng từ nhiều góc độ.

6 thuật toán Classification phổ biến

Có rất nhiều thuật toán classification, mỗi thuật toán có cách tiếp cận và ưu nhược điểm riêng. Việc lựa chọn thuật toán phụ thuộc vào bài toán, loại dữ liệu, và mục tiêu cụ thể. Dưới đây là một số thuật toán phổ biến.

1. Logistic Regression

Logistic Regression là một thuật toán phân loại tuyến tính, sử dụng hàm sigmoid để ước tính xác suất một đối tượng thuộc về một lớp nào đó, thường dùng cho bài toán binary classification.

Mặc dù có tên là “regression” (hồi quy), Logistic Regression thực chất là một thuật toán phân loại. Nó “hồi quy” xác suất, chứ không phải giá trị liên tục. Điểm đặc biệt của Logistic Regression là nó sử dụng hàm sigmoid (logistic function). Hàm này có hình chữ S, nhận đầu vào là bất kỳ giá trị thực nào và trả về đầu ra là một giá trị nằm trong khoảng từ 0 đến 1, có thể được hiểu là xác suất.

Cách hoạt động:

- Tính toán weighted sum: Tương tự như linear regression, Logistic Regression tính tổng trọng số của các đặc trưng đầu vào:

z = w0 + w1*x1 + w2*x2 + ... + wn*xn(trong đówlà trọng số,xlà giá trị đặc trưng). - Áp dụng hàm sigmoid: Đưa giá trị

zvào hàm sigmoid:p = 1 / (1 + exp(-z)). Kết quảplà xác suất đối tượng thuộc về lớp positive (lớp 1). - Phân loại: Nếu

p >= ngưỡng (threshold)(thường là 0.5), đối tượng được phân loại vào lớp 1; ngược lại, vào lớp 0.

2. Decision Tree

Decision Tree là một thuật toán phân loại dựa trên cấu trúc cây, trong đó mỗi nút trong (internal node) đại diện cho một phép kiểm tra trên một đặc trưng, mỗi nhánh đại diện cho một kết quả của phép kiểm tra, và mỗi nút lá đại diện cho một nhãn lớp.

Hãy tưởng tượng bạn đang chơi trò “20 câu hỏi”. Bạn liên tục đặt các câu hỏi “có/không” để thu hẹp phạm vi và cuối cùng đoán ra đối tượng mà người kia đang nghĩ đến. Decision Tree hoạt động tương tự như vậy. Nó chia nhỏ dữ liệu thành các tập con ngày càng nhỏ hơn dựa trên các đặc trưng, cho đến khi đạt được các nút lá thuần nhất (chỉ chứa các đối tượng thuộc cùng một lớp).

Cách hoạt động:

- Bắt đầu từ nút gốc (root node): Chứa toàn bộ dữ liệu.

- Chọn đặc trưng tốt nhất để chia: Sử dụng các độ đo như Information Gain, Gini Index để chọn đặc trưng có khả năng phân biệt giữa các lớp tốt nhất.

- Tạo các nhánh: Mỗi nhánh tương ứng với một giá trị (hoặc một khoảng giá trị) của đặc trưng được chọn.

- Lặp lại: Lặp lại quá trình này cho từng nhánh, cho đến khi:

- Tất cả các đối tượng trong một nút lá thuộc cùng một lớp.

- Đạt đến độ sâu tối đa của cây.

- Không còn đặc trưng nào để chia.

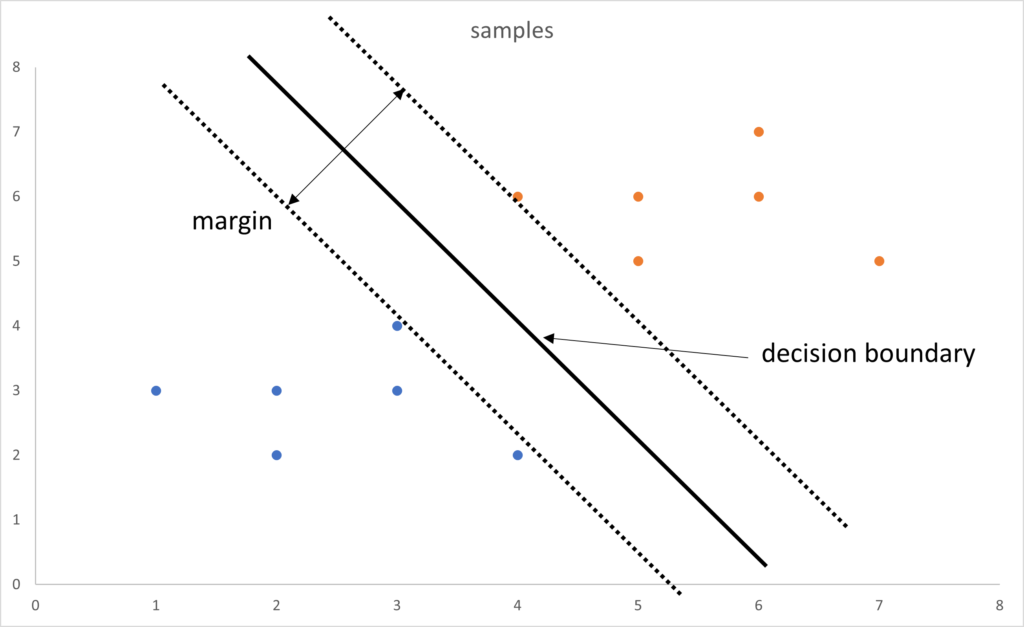

3. Support Vector Machine (SVM)

SVM là một thuật toán phân loại tìm siêu phẳng (hyperplane) tối ưu để phân tách các lớp trong không gian đặc trưng, sao cho lề (margin) giữa siêu phẳng và các điểm dữ liệu gần nhất là lớn nhất.

Hãy tưởng tượng bạn có hai nhóm người đứng ở hai bên một con đường. Bạn muốn vẽ một đường thẳng để phân chia hai nhóm này. Có vô số cách để vẽ đường thẳng đó, nhưng SVM sẽ tìm ra đường thẳng nào “tốt nhất”, tức là đường thẳng có khoảng cách đến những người đứng gần đường nhất của cả hai nhóm là lớn nhất.

Cách hoạt động:

- Biến đổi dữ liệu (nếu cần): Sử dụng kernel trick để ánh xạ dữ liệu sang không gian chiều cao hơn, nơi có thể tìm thấy siêu phẳng phân tách.

- Tìm siêu phẳng tối ưu: Giải bài toán tối ưu để tìm siêu phẳng có lề lớn nhất. Các điểm dữ liệu nằm trên lề được gọi là các support vectors (vectơ hỗ trợ).

- Phân loại: Một điểm dữ liệu mới được phân loại dựa trên việc nó nằm ở phía nào của siêu phẳng.

4. Naive Bayes

Naive Bayes là một thuật toán phân loại dựa trên định lý Bayes, với giả định “ngây thơ” (naive) rằng các đặc trưng là độc lập với nhau.

Naive Bayes là một thuật toán “học” từ dữ liệu bằng cách tính toán xác suất. Nó xem xét xác suất xuất hiện của từng đặc trưng trong từng lớp, và sử dụng định lý Bayes để tính xác suất một đối tượng thuộc về một lớp nào đó dựa trên các đặc trưng của đối tượng đó.

Cách hoạt động:

- Tính xác suất tiên nghiệm (prior probability): Xác suất của từng lớp trong tập dữ liệu huấn luyện (ví dụ: tỷ lệ email spam trong tập dữ liệu huấn luyện).

- Tính xác suất có điều kiện (conditional probability): Xác suất xuất hiện của từng đặc trưng trong từng lớp (ví dụ: xác suất từ “khuyến mãi” xuất hiện trong email spam).

- Áp dụng định lý Bayes: Tính xác suất một đối tượng thuộc về từng lớp dựa trên các đặc trưng của đối tượng đó và các xác suất đã tính ở trên.

- Phân loại: Chọn lớp có xác suất cao nhất.

5. k-Nearest Neighbors (k-NN)

Đây là một thuật toán phân loại dựa trên khoảng cách, phân loại một đối tượng dựa trên nhãn của k đối tượng gần nhất trong tập dữ liệu huấn luyện.

k-NN là một thuật toán “lười biếng” (lazy learner), tức là nó không thực sự “học” một mô hình từ dữ liệu huấn luyện. Thay vào đó, nó ghi nhớ toàn bộ dữ liệu huấn luyện và thực hiện phân loại dựa trên việc so sánh đối tượng mới với các đối tượng trong tập huấn luyện.

Cách hoạt động:

- Chọn giá trị k: Số lượng láng giềng gần nhất cần xem xét.

- Tính khoảng cách: Tính khoảng cách từ đối tượng mới đến tất cả các đối tượng trong tập huấn luyện (thường sử dụng khoảng cách Euclidean).

- Tìm k láng giềng gần nhất: Chọn ra k đối tượng có khoảng cách nhỏ nhất.

- Phân loại: Gán đối tượng mới vào lớp chiếm đa số trong số k láng giềng gần nhất.

6. Random Forest

Random Forest là một thuật toán ensemble learning (học kết hợp), kết hợp nhiều cây quyết định (decision tree) để đưa ra dự đoán, giúp cải thiện độ chính xác và giảm overfitting.

Random Forest giống như một “hội đồng” các cây quyết định. Mỗi cây quyết định được huấn luyện trên một tập con dữ liệu ngẫu nhiên và một tập con đặc trưng ngẫu nhiên. Khi cần dự đoán, mỗi cây sẽ đưa ra một phiếu bầu, và Random Forest sẽ chọn lớp có nhiều phiếu bầu nhất.

Cách hoạt động:

- Tạo nhiều cây quyết định:

- Chọn ngẫu nhiên một tập con dữ liệu từ tập dữ liệu huấn luyện (bagging).

- Chọn ngẫu nhiên một tập con đặc trưng từ tập đặc trưng.

- Xây dựng một cây quyết định trên tập con dữ liệu và tập con đặc trưng đã chọn.

- Lặp lại: Lặp lại bước 1 nhiều lần để tạo ra một “rừng” các cây quyết định.

- Phân loại: Khi cần phân loại một đối tượng mới, đưa đối tượng đó qua tất cả các cây trong rừng. Mỗi cây sẽ đưa ra một dự đoán. Kết quả cuối cùng là lớp có nhiều dự đoán nhất.

Quy trình thực hiện bài toán Classification

1. Thu thập dữ liệu (Data Collection)

Đây là bước khởi đầu, và cũng là bước quan trọng nhất. Chất lượng của mô hình Classification phụ thuộc rất lớn vào chất lượng của dữ liệu đầu vào. Bạn cần xác định rõ nguồn dữ liệu (từ cơ sở dữ liệu nội bộ, từ web scraping, từ các nguồn dữ liệu mở, hay từ các nhà cung cấp dữ liệu), và đảm bảo dữ liệu thu thập được phải đủ lớn, đa dạng, và đại diện cho bài toán mà bạn muốn giải quyết.

Ví dụ, nếu bạn muốn xây dựng một mô hình phân loại email spam, bạn cần thu thập một lượng lớn email, bao gồm cả email spam và email không phải spam, từ nhiều nguồn khác nhau. Hoặc, nếu muốn phân loại hình ảnh chó mèo, cần có đủ ảnh chó, mèo với nhiều giống loài, góc chụp, màu sắc…

Một phần không thể thiếu của bước này là gán nhãn dữ liệu (labeling). Vì Classification là một bài toán supervised learning, bạn cần phải có nhãn cho từng mẫu dữ liệu trong tập huấn luyện. Ví dụ, với email, bạn cần phải chỉ rõ email nào là spam, email nào không phải spam. Với ảnh chó mèo, bạn cần phải gán nhãn “chó” hoặc “mèo” cho từng ảnh. Việc gán nhãn phải chính xác và nhất quán.

2. Tiền xử lý dữ liệu (Data Preprocessing)

Dữ liệu thô thường không “sạch” và không sẵn sàng để đưa vào mô hình. Bước tiền xử lý dữ liệu giúp làm sạch, biến đổi, và chuẩn hóa dữ liệu, giúp mô hình hoạt động hiệu quả hơn.

Làm sạch dữ liệu (Data Cleaning)

-

- Xử lý dữ liệu thiếu (missing values): Có thể xóa các mẫu dữ liệu có giá trị thiếu, hoặc điền giá trị thiếu bằng các phương pháp như: giá trị trung bình, giá trị trung vị, giá trị thường xuất hiện nhất (mode), hoặc sử dụng các thuật toán dự đoán để điền giá trị thiếu.

- Xử lý dữ liệu nhiễu (noisy data): Loại bỏ các giá trị bất thường, sai lệch (ví dụ: tuổi = 200).

- Xử lý dữ liệu ngoại lai (outliers): Phát hiện và xử lý các giá trị cực đoan (ví dụ: thu nhập quá cao hoặc quá thấp so với phần còn lại).

Chuyển đổi dữ liệu (Data Transformation)

- Mã hóa dữ liệu phân loại (categorical data):

- One-hot encoding: Biến đổi mỗi giá trị phân loại thành một vector nhị phân (ví dụ: màu sắc = [“đỏ”, “xanh”, “vàng”] -> [1, 0, 0], [0, 1, 0], [0, 0, 1]).

- Label encoding: Gán mỗi giá trị phân loại bằng một số nguyên (ví dụ: màu sắc = [“đỏ”, “xanh”, “vàng”] -> 1, 2, 3).

- Chuẩn hóa dữ liệu (scaling/normalization): Đưa các đặc trưng về cùng một khoảng giá trị, giúp các thuật toán hoạt động tốt hơn (ví dụ: đưa các giá trị về khoảng [0, 1] hoặc có trung bình = 0 và độ lệch chuẩn = 1).

Giảm chiều dữ liệu (Dimensionality Reduction)

- Principal Component Analysis (PCA): Chiếu dữ liệu xuống một không gian có số chiều thấp hơn, nhưng vẫn giữ lại được phần lớn thông tin.

3. Trích chọn đặc trưng (Feature Engineering)

Bước này nhằm mục đích tạo ra các đặc trưng (features) tốt nhất cho mô hình. “Tốt” ở đây có nghĩa là các đặc trưng có khả năng phân biệt giữa các lớp cao, và không chứa thông tin thừa, nhiễu.

- Lựa chọn đặc trưng (Feature Selection):

- Loại bỏ các đặc trưng không quan trọng, không liên quan đến bài toán, hoặc có tương quan cao với các đặc trưng khác.

- Sử dụng các phương pháp như:

- Filter methods: Dựa trên các độ đo thống kê (ví dụ: correlation, mutual information, chi-square).

- Wrapper methods: Thử nghiệm các tập con đặc trưng khác nhau và đánh giá hiệu quả của mô hình.

- Embedded methods: Tích hợp việc chọn đặc trưng vào quá trình huấn luyện mô hình (ví dụ: LASSO, Ridge regression, Decision Tree).

- Tạo đặc trưng mới (Feature Creation):

- Kết hợp các đặc trưng hiện có để tạo ra các đặc trưng mới có ý nghĩa hơn.

- Ví dụ:

- Trong bài toán phân loại văn bản, có thể tạo đặc trưng mới là tần suất xuất hiện của các cụm từ (n-grams).

- Trong bài toán phân loại hình ảnh, có thể tạo đặc trưng mới bằng cách trích xuất các đặc điểm từ các lớp ẩn của mạng nơ-ron tích chập (Convolutional Neural Network).

4. Chọn mô hình (Model Selection)

Không có một thuật toán Classification nào là tốt nhất cho mọi bài toán. Việc lựa chọn thuật toán phụ thuộc vào nhiều yếu tố:

- Loại bài toán: Binary classification, multiclass classification, hay multi-label classification?

- Loại dữ liệu: Dữ liệu số, dữ liệu phân loại, dữ liệu văn bản, dữ liệu hình ảnh…?

- Số lượng dữ liệu: Dữ liệu có đủ lớn để huấn luyện các mô hình phức tạp không?

- Yêu cầu về độ chính xác, tốc độ, khả năng diễn giải: Bạn cần mô hình có độ chính xác cao nhất, hay cần mô hình có thể chạy nhanh, hay cần mô hình dễ hiểu?

Lời khuyên của tôi là hãy thử nghiệm nhiều thuật toán khác nhau và so sánh hiệu quả của chúng trên dữ liệu của bạn. Bắt đầu với các thuật toán đơn giản (ví dụ: Logistic Regression, Naive Bayes), sau đó thử các thuật toán phức tạp hơn (ví dụ: SVM, Random Forest, Gradient Boosting, Neural Networks).

5. Huấn luyện mô hình (Model Training)

Sau khi đã chọn được thuật toán, bạn sẽ sử dụng tập dữ liệu huấn luyện (training data) để “dạy” mô hình. Quá trình này bao gồm việc tìm ra các tham số tối ưu của mô hình sao cho mô hình có thể dự đoán đúng nhãn của các mẫu dữ liệu trong tập huấn luyện.

Ví dụ, với Logistic Regression, quá trình huấn luyện là tìm ra các trọng số (weights) của các đặc trưng và hệ số tự do (bias) sao cho hàm loss (đo sự khác biệt giữa dự đoán của mô hình và nhãn thực tế) là nhỏ nhất.

Lưu ý: Cần chia dữ liệu thành tập huấn luyện (training set) và tập kiểm tra (test set). Tập huấn luyện dùng để huấn luyện mô hình, còn tập kiểm tra dùng để đánh giá hiệu quả của mô hình trên dữ liệu mới (sẽ được nói rõ hơn ở bước sau).

6. Đánh giá mô hình (Model Evaluation)

Sau khi huấn luyện, bạn cần đánh giá xem mô hình hoạt động tốt như thế nào trên dữ liệu mới. Việc này giúp bạn biết được mô hình có đủ tốt để sử dụng trong thực tế hay không, và có cần phải cải thiện thêm hay không.

Sử dụng tập kiểm tra (test set) – tập dữ liệu mà mô hình chưa từng “nhìn thấy” trong quá trình huấn luyện để đánh giá. Sử dụng các độ đo như Accuracy, Precision, Recall, F1-score, Confusion Matrix, ROC Curve, AUC để đánh giá.

7. Tinh chỉnh mô hình (Model Tuning)

Hiếm khi mô hình đạt được hiệu quả tốt nhất ngay từ lần huấn luyện đầu tiên. Bước tinh chỉnh mô hình giúp bạn cải thiện hiệu quả của mô hình bằng cách:

- Điều chỉnh các siêu tham số (hyperparameters) của mô hình: Ví dụ, với Decision Tree, bạn có thể điều chỉnh độ sâu tối đa của cây, số lượng mẫu tối thiểu để chia một nút… Với SVM, bạn có thể điều chỉnh tham số C (mức độ phạt cho các lỗi phân loại), tham số gamma (độ rộng của kernel)…

- Sử dụng các kỹ thuật như:

- Grid search: Thử nghiệm tất cả các tổ hợp giá trị của các siêu tham số.

- Random search: Thử nghiệm các tổ hợp giá trị ngẫu nhiên của các siêu tham số.

- Bayesian optimization: Sử dụng mô hình xác suất để tìm ra các tổ hợp giá trị có khả năng cao mang lại hiệu quả tốt.

8. Triển khai mô hình (Model Deployment)

Bước cuối cùng là đưa mô hình vào sử dụng trong thực tế. Có nhiều cách để triển khai mô hình:

- Tích hợp vào một ứng dụng web: Ví dụ, một ứng dụng web cho phép người dùng tải lên ảnh và nhận kết quả phân loại (chó/mèo).

- Tích hợp vào một hệ thống nhúng: Ví dụ, một hệ thống camera an ninh tự động phát hiện người lạ.

- Tạo một API (Application Programming Interface): Cho phép các ứng dụng khác truy cập và sử dụng mô hình.

Classification khác gì với Regression?

Classification và Regression đều là các bài toán Supervised Learning (Học có giám sát), nhưng Classification dự đoán nhãn lớp rời rạc, trong khi Regression dự đoán giá trị liên tục.

Classification giống như việc bạn phân loại các quả bóng vào các rổ khác nhau (ví dụ: rổ “đỏ”, rổ “xanh”, rổ “vàng”). Còn Regression giống như việc bạn dự đoán chiều cao của một người dựa trên cân nặng, độ tuổi,… Chiều cao là một giá trị liên tục, có thể là bất kỳ số thực nào trong một khoảng nào đó.

Để hiểu rõ hơn, chúng ta hãy xem xét một số khía cạnh khác biệt chính:

Biến mục tiêu (Target Variable):

- Classification: Biến mục tiêu là phân loại (categorical), rời rạc (discrete). Nó đại diện cho các lớp (classes) hoặc các nhóm (categories).

- Regression: Biến mục tiêu là số (numerical), liên tục (continuous). Nó có thể nhận bất kỳ giá trị nào trong một khoảng.

Đầu ra của mô hình:

- Classification: Đầu ra thường là xác suất của các lớp.

- Regression: Đầu ra là một giá trị số.

Ứng dụng thực tế của Classification

Classification (Phân loại) không chỉ là một khái niệm lý thuyết trong Machine Learning mà còn là một công cụ mạnh mẽ với vô số ứng dụng thực tế, tác động đến hầu hết mọi lĩnh vực trong đời sống và kinh doanh. Từ những việc nhỏ hàng ngày đến các quyết định quan trọng, Classification đang âm thầm giúp chúng ta giải quyết vấn đề và cải thiện cuộc sống.

Phân loại thư rác

Đây có lẽ là ứng dụng classification mà nhiều người trong chúng ta trải nghiệm hàng ngày. Các bộ lọc thư rác sử dụng thuật toán classification (thường là Naive Bayes, SVM, hoặc các mô hình deep learning) để phân loại email thành “spam” hoặc “không spam” (ham).

- Cách hoạt động: Mô hình được huấn luyện trên một tập dữ liệu lớn các email đã được gán nhãn (spam/không spam). Các đặc trưng thường được sử dụng bao gồm:

- Từ ngữ xuất hiện trong email (ví dụ: “khuyến mãi”, “miễn phí”, “trúng thưởng”…).

- Địa chỉ người gửi.

- Tiêu đề email.

- Các đặc điểm khác (ví dụ: có chứa tệp đính kèm không, có chứa liên kết không…).

- Lợi ích: Giúp người dùng không bị làm phiền bởi thư rác, tiết kiệm thời gian, và bảo vệ khỏi các email lừa đảo.

Chẩn đoán bệnh

Classification đóng vai trò quan trọng trong việc hỗ trợ các bác sĩ chẩn đoán bệnh dựa trên các triệu chứng, kết quả xét nghiệm, hình ảnh y tế (X-quang, MRI, CT scan…).

- Cách hoạt động: Mô hình được huấn luyện trên dữ liệu bệnh án của các bệnh nhân đã được chẩn đoán. Các đặc trưng có thể bao gồm:

- Triệu chứng lâm sàng.

- Kết quả xét nghiệm máu, nước tiểu…

- Đặc điểm từ hình ảnh y tế (ví dụ: hình dạng, kích thước, mật độ của khối u).

- Lợi ích: Giúp chẩn đoán bệnh sớm và chính xác hơn, từ đó tăng khả năng điều trị thành công.

Phân loại hình ảnh

Đây là một lĩnh vực rất sôi động trong computer vision (thị giác máy tính), với nhiều ứng dụng thú vị.

- Cách hoạt động: Mô hình (thường là convolutional neural networks – CNN) được huấn luyện trên một tập dữ liệu lớn các hình ảnh đã được gán nhãn (ví dụ: ảnh chó, mèo, ô tô, máy bay…).

- Lợi ích: Mở ra nhiều ứng dụng trong các lĩnh vực như an ninh, giao thông, thương mại điện tử, giải trí…

Phân loại văn bản

Classification được sử dụng rộng rãi để xử lý và phân loại văn bản, giúp tự động hóa nhiều tác vụ.

- Cách hoạt động: Mô hình (thường là Naive Bayes, SVM, hoặc các mô hình deep learning như RNN, Transformer) được huấn luyện trên một tập dữ liệu văn bản đã được gán nhãn. Các đặc trưng thường là từ ngữ, cụm từ, hoặc các biểu diễn vector của văn bản (word embeddings).

- Lợi ích: Giúp tự động hóa việc phân loại và quản lý văn bản, tiết kiệm thời gian và công sức.

Nhận dạng chữ viết tay

Classification giúp chuyển đổi chữ viết tay thành văn bản số, mở ra nhiều ứng dụng tiện lợi.

Cách hoạt động: Mô hình (thường là CNN hoặc RNN) được huấn luyện trên một tập dữ liệu lớn các ký tự viết tay đã được gán nhãn

Phát hiện gian lận

Classification được sử dụng để phát hiện các giao dịch gian lận, bảo vệ các tổ chức tài chính và khách hàng.

- Cách hoạt động: Mô hình được huấn luyện trên dữ liệu các giao dịch đã được gán nhãn (gian lận/không gian lận). Các đặc trưng có thể bao gồm:

- Số tiền giao dịch.

- Địa điểm giao dịch.

- Thời gian giao dịch.

- Lịch sử giao dịch của khách hàng.

- Lợi ích: Giúp phát hiện sớm các giao dịch gian lận, giảm thiểu thiệt hại tài chính.

Classification không chỉ là về việc áp dụng các thuật toán một cách máy móc. Nó đòi hỏi sự hiểu biết sâu sắc về dữ liệu, về bài toán, và về các kỹ thuật phân tích. Hãy bắt đầu từ những kiến thức cơ bản, thực hành thường xuyên, và không ngừng học hỏi. Hy vọng bài viết này đã cung cấp cho bạn một cái nhìn tổng quan và chi tiết về Classification.

Để đáp ứng mọi nhu cầu về hạ tầng cho các dự án Machine Learning, Data Science, và các ứng dụng đòi hỏi hiệu năng cao, InterData.vn cung cấp một loạt các giải pháp máy chủ chất lượng cao. Quý Khách hoàn toàn kiểm soát phần cứng với dịch vụ Thuê Server, sự linh hoạt và khả năng mở rộng của Thuê Cloud Server, hiệu suất ổn định với chi phí tối ưu của Thuê VPS, hay giải pháp phù hợp cho các website nhỏ với Thuê Hosting, InterData.vn đều có thể đáp ứng.

InterData

- Website: Interdata.vn

- Hotline 24/7: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh