Bạn đang tìm cách nâng cao độ chính xác và ổn định cho mô hình học máy của mình? Ensemble Learning (Học tập tổ hợp) chính là một kỹ thuật mạnh mẽ có thể giúp bạn đạt được điều đó. Bằng cách kết hợp dự đoán từ nhiều mô hình riêng lẻ, Ensemble Learning thường mang lại kết quả vượt trội so với việc chỉ sử dụng một mô hình đơn lẻ.

Bài viết này sẽ cung cấp cái nhìn toàn diện về Ensemble Learning là gì, khám phá thời điểm lý tưởng để áp dụng, đi sâu vào tìm hiểu những ưu nhược điểm cũng như ứng dụng thực tế ấn tượng trong nhiều lĩnh vực. Đọc ngay.

Ensemble Learning là gì?

Ensemble Learning (Học tập tổ hợp) là một phương pháp trong học máy, trong đó nhiều mô hình được huấn luyện để giải quyết cùng một vấn đề, sau đó kết hợp các dự đoán của chúng nhằm nâng cao hiệu suất tổng thể.

Ý tưởng cốt lõi của học tập tổ hợp là bằng cách kết hợp nhiều mô hình – mỗi mô hình đều có điểm mạnh và điểm yếu riêng – hệ thống tổ hợp có thể đạt được kết quả tốt hơn so với bất kỳ mô hình đơn lẻ nào.

Học tập tổ hợp có thể được áp dụng cho nhiều bài toán trong học máy như phân loại (classification), hồi quy (regression) và phân cụm (clustering). Một số phương pháp học tập tổ hợp phổ biến bao gồm bagging, boosting và stacking.

Khi nào nên sử dụng Ensemble Learning?

Khi đã hiểu sơ lược Ensemble Learning là gì, vậy khi nào nên sử dụng? Học tập tổ hợp đặc biệt hiệu quả trong các tình huống mà dữ liệu có thể bị nhiễu hoặc mất cân bằng.

Dữ liệu nhiễu (Noisy Data)

Dữ liệu nhiễu là những tập dữ liệu chứa lỗi, giá trị ngoại lệ hoặc thông tin không liên quan, khiến cho các mẫu có ý nghĩa bị che khuất. Các mô hình được huấn luyện trên loại dữ liệu này thường gặp khó khăn trong việc khái quát hóa tốt, dẫn đến hiện tượng phương sai cao – mô hình hoạt động tốt trên dữ liệu huấn luyện nhưng lại cho kết quả kém trên dữ liệu chưa từng thấy.

Các phương pháp tổ hợp như bagging có thể giải quyết vấn đề này bằng cách huấn luyện nhiều mô hình trên các tập con khác nhau của dữ liệu. Mỗi mô hình học theo một góc nhìn hơi khác nhau, và khi kết hợp các dự đoán lại với nhau, hiệu ứng của nhiễu sẽ được làm mờ đi.

Random Forest – một kỹ thuật bagging được sử dụng rộng rãi – minh họa rất rõ cách tiếp cận này bằng cách lấy trung bình các dự đoán từ nhiều cây quyết định (decision tree), giúp mô hình cuối cùng ít bị ảnh hưởng bởi các giá trị ngoại lệ và lỗi. Việc tổng hợp này làm giảm phương sai, từ đó cho ra dự đoán ổn định và chính xác hơn.

Tập dữ liệu mất cân bằng (Imbalanced Data Sets)

Ngược lại, tập dữ liệu mất cân bằng là một thách thức khác khi một lớp (class) chiếm ưu thế hơn hẳn so với các lớp còn lại. Ví dụ, trong phát hiện gian lận, số giao dịch hợp pháp thường nhiều hơn rất nhiều so với giao dịch gian lận.

Một mô hình đơn giản có thể chỉ dự đoán lớp chiếm đa số để đạt được độ chính xác cao, nhưng hoàn toàn bỏ qua lớp thiểu số. Điều này dẫn đến sai lệch lớn – mô hình không học được đặc điểm quan trọng của lớp thiểu số.

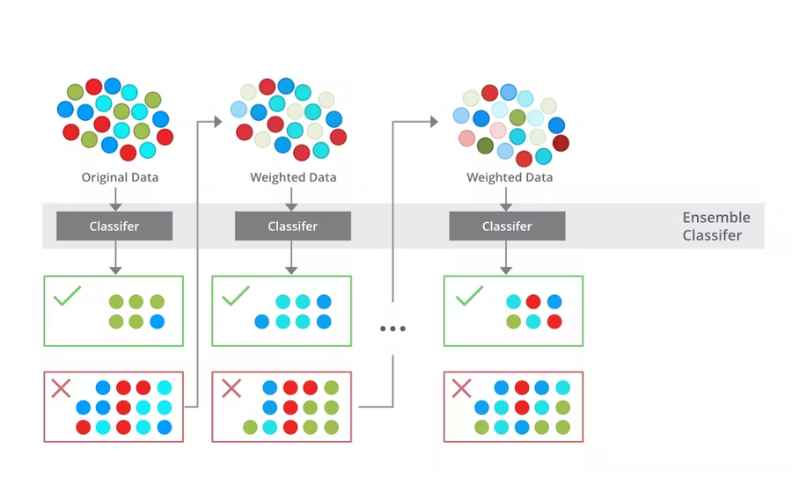

Các kỹ thuật boosting như AdaBoost và Gradient Boosting giải quyết vấn đề này bằng cách huấn luyện mô hình một cách tuần tự, trong đó mỗi mô hình tiếp theo tập trung vào các mẫu bị phân loại sai ở bước trước đó.

Quá trình lặp lại này giúp mô hình học tốt hơn từ lớp thiểu số, từ đó giảm sai lệch (bias). Trong khi đó, phương pháp bagging cũng hỗ trợ bằng cách tạo ra các tập dữ liệu con cân bằng để huấn luyện, đảm bảo lớp thiểu số được thể hiện đầy đủ.

Các loại học tập tổ hợp Ensemble Learning

Chúng ta có thể tiếp cận học tập tổ hợp thông qua nhiều kỹ thuật, từ những phương pháp đơn giản đến các thuật toán nâng cao. Dưới đây là cả hai dạng đơn giản và phức tạp, cùng cách ứng dụng chúng trong thực tế.

Max Voting

Trong các bài toán phân loại, mỗi mô hình con (base model) sẽ “bỏ phiếu” cho một lớp đầu ra. Lớp có số phiếu cao nhất sẽ được chọn làm kết quả cuối cùng. Phương pháp này hiệu quả khi các mô hình con có hiệu suất tương đương nhau và cùng góp phần vào quyết định chung.

Averaging

Với các bài toán hồi quy, kết quả đầu ra của tất cả mô hình sẽ được lấy trung bình để đưa ra dự đoán cuối cùng. Cách này giúp làm giảm lỗi của từng mô hình riêng lẻ, từ đó tạo ra một kết quả tổng thể chính xác hơn.

Ví dụ, khi dự đoán giá nhà, việc lấy trung bình dự đoán từ ba mô hình khác nhau sẽ cho kết quả đáng tin cậy hơn là chỉ dùng một mô hình.

Weighted Average

Đây là phiên bản nâng cao của phương pháp trung bình, trong đó mỗi mô hình được gán trọng số dựa trên hiệu suất của nó. Mô hình có độ chính xác cao hoặc sai số thấp hơn sẽ có trọng số lớn hơn trong kết quả cuối cùng. Phương pháp này đặc biệt hữu ích khi một số mô hình trong tổ hợp hoạt động tốt hơn những mô hình còn lại.

Ensemble Learning hoạt động như thế nào?

Cơ chế hoạt động của học tập tổ hợp như sau:

- Kết hợp nhiều mô hình: Các phương pháp tổ hợp sử dụng nhiều mô hình khác nhau (như cây quyết định, SVM, v.v.). Các mô hình này có thể cùng loại hoặc khác loại. Bằng cách kết hợp dự đoán của chúng, kết quả đạt được sẽ mạnh mẽ hơn.

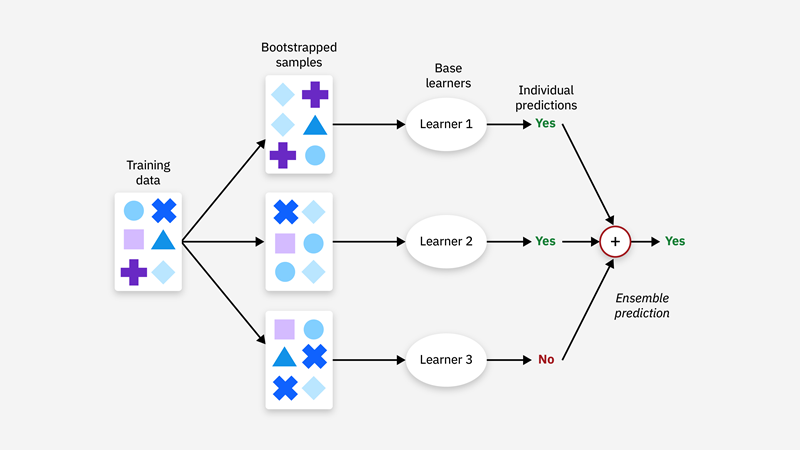

- Bagging: Phương pháp này huấn luyện nhiều mô hình trên các tập dữ liệu con được chọn ngẫu nhiên từ dữ liệu huấn luyện. Mục tiêu là giảm phương sai và tránh hiện tượng quá khớp (overfitting) bằng cách trung bình hóa các dự đoán.

- Boosting: Khác với bagging, boosting huấn luyện các mô hình theo trình tự, trong đó mô hình mới tập trung vào những lỗi mà mô hình trước mắc phải. Kỹ thuật này giúp cải thiện độ chính xác bằng cách giảm sai lệch.

- Hệ thống bỏ phiếu: Trong các bài toán phân loại, phương pháp tổ hợp thường sử dụng hình thức bỏ phiếu đa số, trong đó kết quả cuối cùng được quyết định dựa trên số phiếu từ các mô hình thành phần.

- Stacking: Phương pháp này huấn luyện một mô hình mới để kết hợp dự đoán từ nhiều mô hình con, học cách tích hợp đầu ra một cách tối ưu nhất.

Bằng cách áp dụng các chiến lược trên, học tập tổ hợp có thể cải thiện hiệu suất mô hình một cách hiệu quả, và trở thành một phương pháp quan trọng mà các nhà khoa học dữ liệu (data scientists) và kỹ sư học máy (machine learning engineers) thường xuyên sử dụng.

Những ưu điểm của Ensemble Learning

Học tập tổ hợp là một kỹ thuật mạnh mẽ trong học máy, kết hợp nhiều mô hình để cải thiện hiệu suất và độ chính xác. Phương pháp này đặc biệt có giá trị trong nhiều lĩnh vực nhờ khả năng nâng cao độ chính xác trong dự đoán và giảm thiểu sai số. Dưới đây là một số lợi ích nổi bật:

- Cải thiện độ chính xác: Việc tổng hợp dự đoán từ nhiều mô hình thường mang lại kết quả tốt hơn so với sử dụng một mô hình đơn lẻ.

- Tăng độ ổn định: Học tập tổ hợp giúp giảm hiện tượng quá khớp (overfitting), từ đó tạo ra các mô hình đáng tin cậy hơn và hoạt động tốt trên dữ liệu chưa thấy.

- Tính linh hoạt: Các phương pháp tổ hợp như boosting và bagging có thể áp dụng với nhiều thuật toán và loại dữ liệu khác nhau.

- Giảm phương sai: Những kỹ thuật như bagging có thể làm giảm sự dao động trong dự đoán, từ đó giúp kết quả đầu ra ổn định hơn.

- Khả năng khái quát hóa tốt hơn: Việc kết hợp nhiều mô hình giúp mô hình học tốt hơn trên dữ liệu mới, phù hợp với các ứng dụng trong thực tế.

Việc áp dụng các chiến lược học tập tổ hợp có thể nâng cao đáng kể hiệu quả của các giải pháp học máy.

Một số nhược điểm của Ensemble Learning

Dù học tập tổ hợp mang lại nhiều lợi ích, nhưng cũng tồn tại một số hạn chế cần cân nhắc:

- Tăng độ phức tạp: Việc kết hợp nhiều mô hình có thể khiến hệ thống trở nên phức tạp và khó giải thích hơn.

- Thời gian huấn luyện dài hơn: Việc huấn luyện đồng thời nhiều mô hình có thể làm tăng thời gian tính toán.

- Nguy cơ quá khớp: Nếu không được triển khai cẩn thận, các phương pháp tổ hợp vẫn có thể bị quá khớp với dữ liệu huấn luyện.

Những thách thức này có thể ảnh hưởng đến hiệu suất và khả năng triển khai của mô hình, đòi hỏi sự cẩn trọng trong quá trình thực hiện.

Ứng dụng thực tế của Ensemble Learning

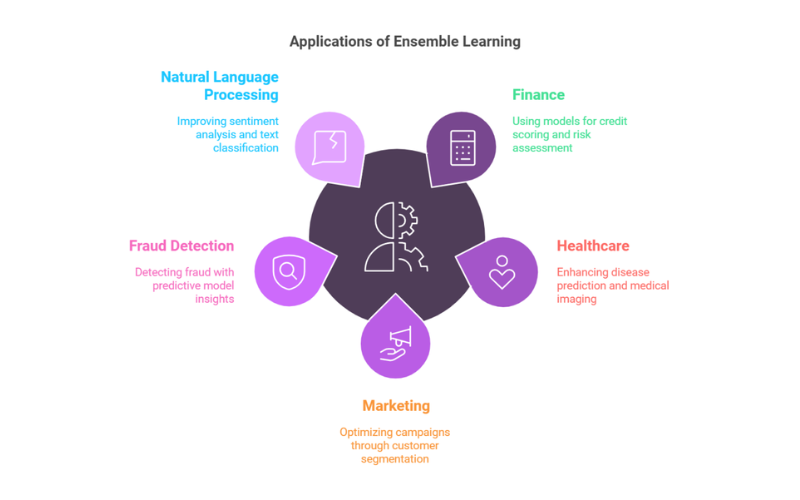

Học tập tổ hợp hiện được sử dụng khá phổ biến trong học sâu và đã được ứng dụng để giải quyết rất nhiều bài toán phức tạp. Phương pháp này đã hỗ trợ hiệu quả trong việc nhận dạng mẫu (pattern recognition) ở mức độ cao, như xử lý hình ảnh và video, ví dụ như nhận diện đối tượng (object detection), nơi mô hình cần tạo ra các hộp giới hạn (bounding boxes) quanh vật thể và phân loại hình ảnh (image classification).

Dưới đây là một số ứng dụng thực tiễn của Ensemble Learning:

1. Phát hiện bệnh

Ensemble Learning hỗ trợ hiệu quả trong việc phân loại và định vị các loại bệnh nhằm đưa ra chẩn đoán nhanh chóng và đơn giản hơn. Ví dụ, mô hình được áp dụng trong việc phát hiện bệnh tim mạch qua ảnh chụp X-quang và CT.

2. Viễn thám (Remote Sensing)

Viễn thám là quá trình theo dõi các đặc điểm vật lý của một khu vực mà không cần tiếp xúc trực tiếp. Đây là một nhiệm vụ khó khăn vì dữ liệu thu thập từ các cảm biến khác nhau có độ phân giải không đồng đều, dẫn đến sự không nhất quán trong phân bố dữ liệu.

Các tác vụ như phát hiện sạt lở đất và phân loại cảnh quan đã được thực hiện thành công nhờ học tập tổ hợp.

3. Phát hiện gian lận

Việc phát hiện gian lận kỹ thuật số là một thách thức lớn vì yêu cầu độ chính xác rất cao để tự động hóa quy trình. Học tập tổ hợp đã chứng minh hiệu quả trong việc phát hiện gian lận thẻ tín dụng và gian lận lượt hiển thị quảng cáo.

4. Nhận dạng cảm xúc trong giọng nói

Học tập tổ hợp cũng được áp dụng trong việc nhận dạng cảm xúc từ giọng nói, đặc biệt trong môi trường đa ngôn ngữ. Kỹ thuật này cho phép kết hợp hiệu quả của tất cả các bộ phân loại, thay vì chỉ chọn một bộ phân loại duy nhất và đánh đổi độ chính xác của các tập ngôn ngữ khác nhau.

5. Nông nghiệp

Mô hình tổ hợp giúp giảm thiểu nhiễu và giá trị ngoại lệ, từ đó cho ra dự đoán chính xác hơn. Điều này rất hữu ích trong các bài toán dự đoán doanh số bán hàng, phân tích thị trường chứng khoán, và dự báo thời tiết.

Trong nông nghiệp, Ensemble Learning có thể được sử dụng để dự đoán năng suất cây trồng. Bằng cách kết hợp các dự đoán từ nhiều mô hình được huấn luyện trên các yếu tố môi trường khác nhau như nhiệt độ, lượng mưa, và chất lượng đất, mô hình tổ hợp có thể đưa ra dự đoán chính xác hơn về sản lượng thu hoạch.

Các kỹ thuật như stacking và bagging giúp cải thiện hiệu suất và độ tin cậy của mô hình.

6. Bảo hiểm

Các công ty bảo hiểm cũng có thể tận dụng học tập tổ hợp để đánh giá rủi ro và xác định mức phí bảo hiểm. Bằng cách kết hợp dự đoán từ nhiều mô hình được huấn luyện trên các yếu tố như nhân khẩu học, dữ liệu lịch sử, và xu hướng thị trường, các công ty có thể hiểu rõ hơn về rủi ro tiềm ẩn và đưa ra dự đoán chính xác hơn về xác suất yêu cầu bồi thường. Điều này giúp họ thiết lập mức phí hợp lý và đảm bảo hoạt động bảo hiểm bền vững.

7. Viễn thám

Các kỹ thuật học tập tổ hợp như Isolation Forests hay tổ hợp SVM (Support Vector Machines) giúp phát hiện các điểm bất thường trong dữ liệu bằng cách so sánh đầu ra từ nhiều mô hình khác nhau.

Ensemble Learning giúp tăng độ chính xác trong việc phát hiện gian lận, xâm nhập mạng hoặc hành vi bất thường, đồng thời giảm tỷ lệ cảnh báo sai. Những phương pháp này có thể áp dụng trong viễn thám bằng cách kết hợp các mô hình hoặc thuật toán được huấn luyện trên các tập dữ liệu khác nhau, sau đó tổng hợp dự đoán thông qua bỏ phiếu đa số hoặc trung bình có trọng số.

Một ứng dụng thực tế trong viễn thám là quản lý từ xa tài nguyên thiên nhiên và cơ sở hạ tầng, bằng cách cung cấp dữ liệu chính xác và kịp thời để phục vụ cho các quyết định quản lý.

8. Thể thao

Ensemble Learning trong lĩnh vực thể thao được sử dụng để tạo ra các mô hình dự đoán chính xác hơn nhằm hỗ trợ ra quyết định trong nhiều khía cạnh khác nhau của ngành. Các phương pháp phổ biến bao gồm stacking và trung bình có trọng số, giúp cải thiện độ chính xác và hiệu quả của hệ thống gợi ý.

Bằng cách kết hợp dự đoán từ các mô hình học máy hoặc mô hình thống kê, học tập tổ hợp hỗ trợ các đội thể thao, huấn luyện viên và chuyên gia phân tích hiểu rõ hơn về hiệu suất cầu thủ, kết quả trận đấu, và các quyết định chiến thuật.

Cách tiếp cận này còn được áp dụng trong các lĩnh vực như dự đoán chấn thương, tìm kiếm tài năng và nâng cao trải nghiệm người hâm mộ.

Ngoài ra, Ensemble Learning cũng được ứng dụng trong các trường hợp sau:

- Xử lý ngôn ngữ tự nhiên: Cải thiện khả năng phân tích tình cảm và phân loại văn bản thông qua tổng hợp mô hình.

- Tiếp thị: Mô hình tổng hợp giúp phân khúc và nhắm mục tiêu khách hàng, tối ưu hóa các chiến dịch tiếp thị.

Tóm lại, Ensemble Learning đã chứng minh là một phương pháp cực kỳ hiệu quả và linh hoạt trong lĩnh vực học máy, giúp cải thiện đáng kể hiệu suất dự đoán và độ tin cậy của mô hình.

Mặc dù có những hạn chế về tài nguyên tính toán và khả năng diễn giải mô hình, những ưu điểm của Ensemble Learning về độ chính xác và tính ổn định, cùng với các ứng dụng thực tế đa dạng đã khẳng định vị thế quan trọng của nó.

Hiểu rõ Ensemble Learning là gì và các ưu nhược điểm nổi bật của nó sẽ là lợi thế lớn cho bất kỳ ai làm việc với dữ liệu và học máy.

Việc phát triển và thử nghiệm các mô hình học máy phức tạp như Ensemble Learning thường đòi hỏi một hạ tầng tính toán mạnh mẽ và ổn định. Nếu bạn đang tìm kiếm giải pháp, hãy cân nhắc dịch vụ thuê VPS giá rẻ chất lượng tại InterData. Chúng tôi cung cấp các gói VPS với cấu hình cao, sử dụng CPU Intel/AMD đời mới, ổ cứng SSD NVMe U.2 tốc độ cao và băng thông tối ưu, hỗ trợ tốt cho quá trình nghiên cứu và phát triển của bạn.

Khi mô hình Ensemble Learning cần xử lý tập dữ liệu lớn hơn hoặc yêu cầu hiệu năng vượt trội để triển khai thực tế, việc nâng cấp lên Cloud Server là bước đi hợp lý. Khám phá dịch vụ thuê Cloud Server tốc độ cao giá rẻ tại InterData, được xây dựng trên nền tảng phần cứng thế hệ mới nhất, dung lượng lưu trữ SSD NVMe U.2 được tối ưu và băng thông cao, mang đến sự ổn định và sức mạnh xử lý vượt trội cho các tác vụ nặng.

INTERDATA

- Website: Interdata.vn

- Hotline: 1900-636822

- Email: [email protected]

- VPĐD: 240 Nguyễn Đình Chính, P.11. Q. Phú Nhuận, TP. Hồ Chí Minh

- VPGD: Số 211 Đường số 5, KĐT Lakeview City, P. An Phú, TP. Thủ Đức, TP. Hồ Chí Minh