Crawl là gì? Crawl à một khái niệm quan trọng và không thể thiếu trong thế giới Internet hiện đại. Quá trình này đóng vai trò quan trọng trong việc thu thập thông tin từ hàng triệu trang web trên internet và cung cấp kết quả tìm kiếm cho người dùng.

Bài viết này của InterData sẽ giải đáp thêm một số câu hỏi về cách thức hoạt động của web crawler, các yếu tố ảnh hưởng cũng như làm thế nào để tối ưu hóa để mang đến kết quả tốt nhất.

Crawl là gì?

Crawl là quá trình mà các Web Crawler (hay còn gọi là bots hoặc spiders) tự động thu thập thông tin từ các trang web. Quá trình này được thực hiện bằng cách gửi yêu cầu HTTP đến các trang web và sau đó phân tích các phản hồi để lấy các tài nguyên như văn bản, hình ảnh, video, âm thanh, tệp tin, vv.

Đây là một phần quan trọng trong cơ chế hoạt động của các công cụ tìm kiếm như Google, Bing,.. Dữ liệu sau khi phân tích sẽ được lọc ra theo yêu cầu của người dùng hoặc Search Engine.

Các yếu tố ảnh hưởng đến Web Crawler

Domain – tên miền

Thuật toán Panda của Google ra đời nhằm đánh giá tên miền nên việc ở hữu tên miền chất lượng rất quan trọng. Domain chứa từ khóa chính được đánh giá tốt thì web crawler cũng sẽ tốt thứ hạng trên kết quả tìm kiếm cũng cao hơn.

Backlinks

Các backlink chất lượng đóng vai trò quan trọng góp phần giúp website thân thiện với công cụ tìm kiếm hơn. Nếu nội dung trên trang của bạn tốt nhưng lại không xuất hiện backlinks nào, thì Google sẽ chỉ định website của bạn kém chất lượng, không cung cấp nội dung giá trị cho độc giả.

Internal links

Internal Link là các liên kết nội bộ trong một website, là một trong những yếu tố bắt buộc nhất định cần phải có khi làm SEO. Ngoài ra, Internal Link còn giúp tăng thời gian onsite của người dùng.

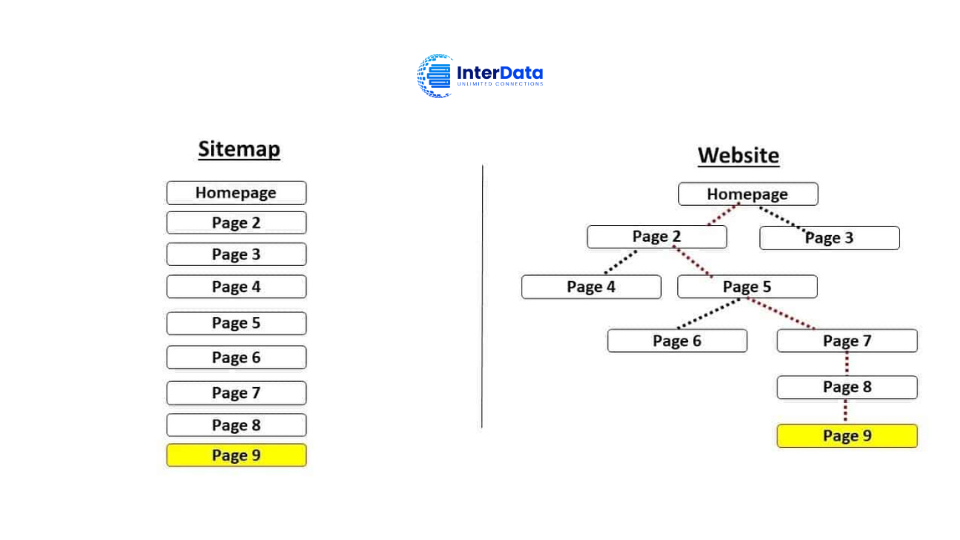

XML Sitemap

Tệp sitemap.xml là một danh sách các URL trên trang web, giúp các Web Crawler hiểu cấu trúc của trang và dễ dàng tìm trang mới. Sitemap ảnh hưởng đến hiệu suất và hiệu quả của crawl.

Nội dung trùng lặp

Nếu nội dung trùng lặp quá nhiều web crawler sẽ căn cứ vào thời gian để đánh giá rằng bạn có đang copy hay không? Điều này làm công cụ tìm kiếm đánh giá trang không có nội dung chất lượng.

URL Canonical

URL là một phần mã trong HTML, URL canonical dùng để chỉ ra đâu là URL chính của trang web bạn. Một website không chỉ nội dung, liên kết,… thân thiện với nền tảng mà cả URL cũng cần thân thiện với mỗi trang trên website.

Trong trường hợp nội dung bị Duplicate hoặc giống nhau trên nhiều URL, bạn có thể sử dụng URL Canonical, nó sẽ cho bạn biết trang web nào là trang chính, giúp tránh duplicate content và tối ưu hóa hiệu suất crawl.

Meta Tags

Meta tags được sử dụng để chú thích thông tin về trang web, chúng không hiển thị trực tiếp qua trình duyệt, mà chỉ là các dữ liệu mô tả cung cấp thông tin quan trọng về trang web và nội dung của bạn cho các công cụ tìm kiếm bao gồm tiêu đề, mô tả và từ khóa.. Việc có thêm meta tags tốt có thể đảm bảo website bạn sẽ có thứ hạng cao.

Crawl hoạt động như thế nào?

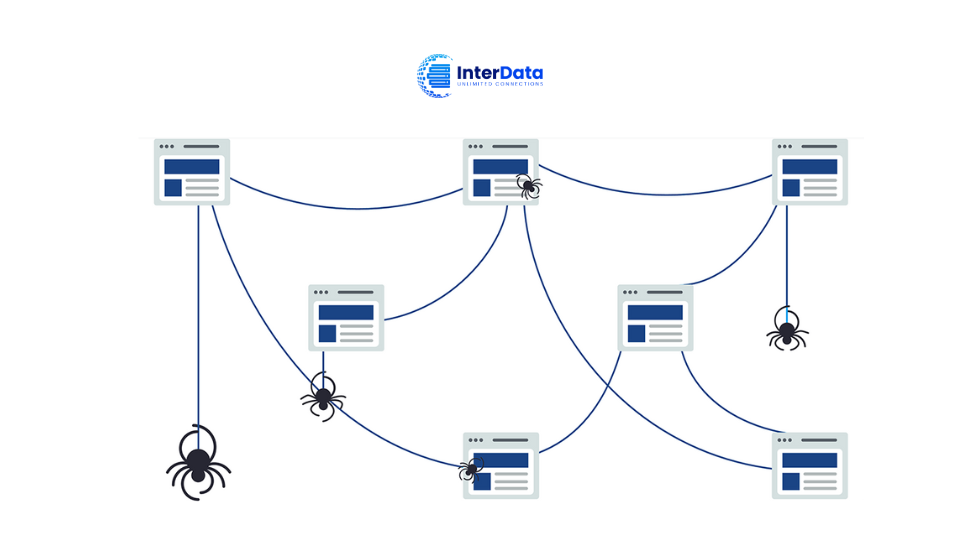

Web Crawler hoạt động bằng cách truy các liên kết trên trang web từ các liên kết có sẵn. Web crawler theo dõi các liên kết trên các trang web và thu thập thông tin từ các trang đó.

Khi web crawler tìm thấy một trang mới, nó sẽ tải về trang đó và trích xuất thông tin từ trang đó, bao gồm cả văn bản, hình ảnh và các liên kết khác. Các thông tin này sau đó được lưu trữ trong cơ sở dữ liệu của công cụ tìm kiếm và sử dụng để cung cấp kết quả tìm kiếm cho người dùng.

Tại các URL ban đầu, các con nhện này sẽ tìm ra các siêu liên kết dẫn đến nhiều URL khác, rồi tiếp tục tạo thành các list cần thu thập thông tin tiếp theo,… các vòng như vậy sẽ lặp đi lặp lại không ngừng không có thời hạn. Tuy nhiên, web crawler sẽ tuân theo một số quy tắc để quá trình thu thập dữ liệu diễn ra năng suất hơn.

Revisiting webpages

Web Crawler sẽ cần phải truy cập lại các trang theo định kỳ để đảm bảo rằng sẽ luôn cập nhật phiên bản mới nhất của nội dung được lập danh sách trước đó.

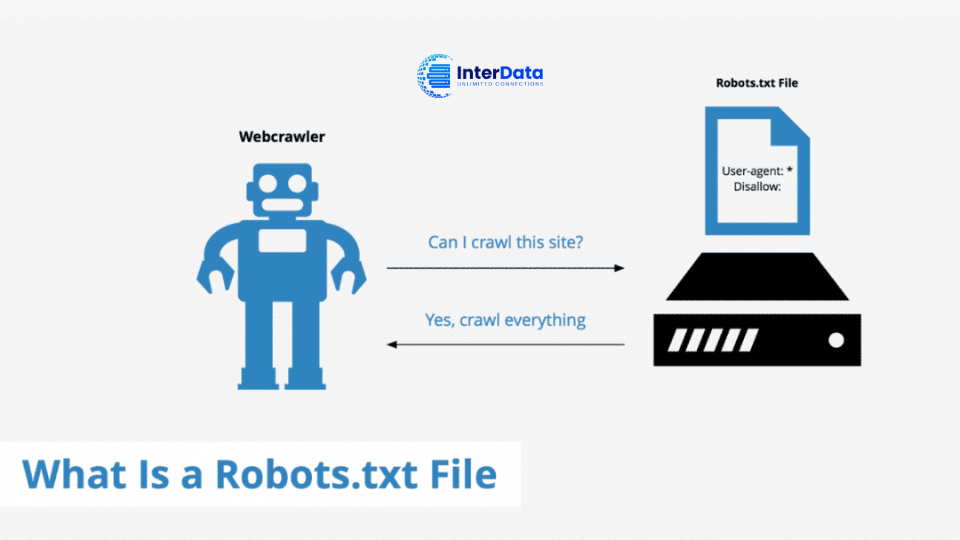

Yêu cầu về Robots.txt:

Việc các trang có được thu thập thông tin dựa trên giao thức robots.txt hay không cũng sẽ do Web crawlers quyết định (còn được gọi là robot giao thức loại trừ). Trước hết web crawlers sẽ kiểm tra các tệp robot.txt của máy chủ trang web đó, sau đó mới thu thập các thông tin từ trang web.

Tệp robots.txt là một tệp văn bản chỉ định các quy tắc cho bất kỳ bot nào truy cập vào website hoặc ứng dụng được lưu trữ. Những quy tắc này giúp bot xác định trang nào được phép thu thập thông tin hay những liên kết nào chúng có thể tiến hành theo dõi.

Những thành tố này đều có trọng số không giống nhau tùy vào những thuật toán độc quyền mà mỗi công cụ tìm kiếm tự thiết lập cho các spider bots của họ. Dù mục đích cuối cùng là để index nội dung từ website nhưng web crawlers sẽ có cách hoạt động khác nhau ở mỗi công cụ tìm kiếm.

Cách tối ưu hóa crawl

Tối ưu Crawl rất quan trọng khi xây dựng web. Nếu web được tối ưu và crawl tốt sẽ đảm bảo được việc các công cụ tìm kiếm như Google sẽ tìm thấy trang của bạn.

Bên cạnh tối ưu hóa SEO, bạn cũng cần để ý đến những yếu tố sau:

Hiệu suất máy chủ

Trang web của bạn nó có thể xử lý số lượng lập chỉ mục mà Googlebot muốn mà không làm chậm thời gian phản hồi hoặc gây ra lỗi tiêu cực.

Hãy kiểm tra tình trạng máy chủ trang web của bạn trong Google Search Console và đảm bảo rằng tỷ lệ lỗi 5xx dưới 1% và thời gian phản hồi duy trì dưới 300 mili giây.

Tối ưu hóa cấu trúc website

Cấu trúc hợp lý của trang web giúp công cụ tìm kiếm dễ dàng thu thập và hiểu thông tin trên trang của bạn.

Tối ưu nội dung

Loại bỏ những nội dung thừa và cung cấp nội dung chất lượng có giá trị cho người dùng là một yếu tố quan trọng.

Bằng cách sử dụng từ khóa phù hợp và đảm bảo rằng cấu trúc nội dung hợp lý, công cụ tìm kiếm sẽ hiểu rõ hơn về nội dung của bạn và tăng khả năng xếp hạng trang web của bạn trong kết quả tìm kiếm.

Dùng Robots.txt

Sau khi các công cụ tìm kiếm đã crawl trang web của bạn, bạn có thể kiểm tra việc crawl bằng cách sử dụng Google Search Console hoặc các công cụ tương tự.

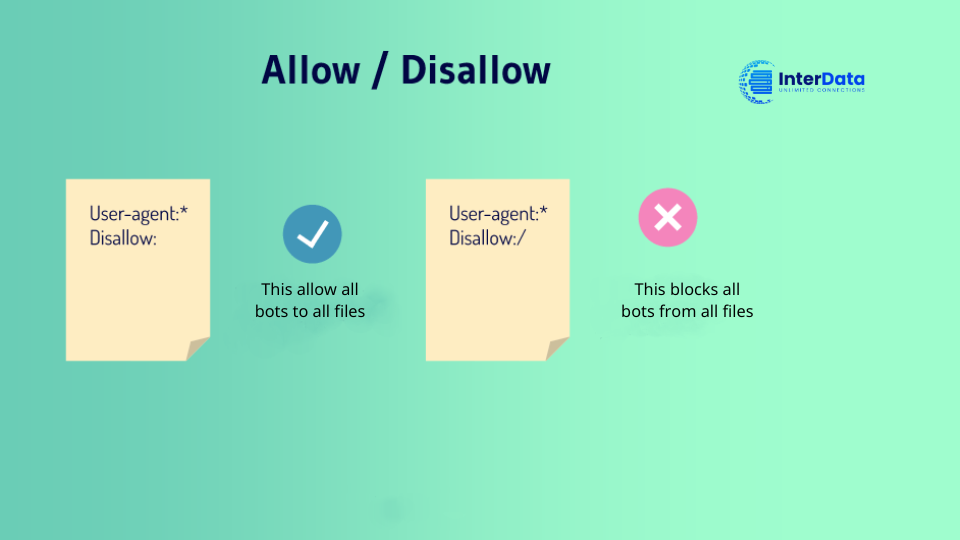

Nếu bạn thấy rằng một số trang của bạn không được crawl hoặc có các vấn đề khác liên quan đến crawl, bạn có thể sửa chúng bằng cách thêm các tập tin robots.txt hoặc sitemap.xml vào trang web của bạn. Robots.txt là một tệp văn bản đặc biệt mà bạn đặt trên máy chủ web của mình để chỉ định cho công cụ tìm kiếm biết trang nào nên hoặc không nên quét.

Hướng dẫn google bot lập chỉ mục

Sử dụng trang XML được tối ưu hóa sẽ hướng dẫn Google bot đến các URL liên quan đến SEO. Tối ưu hóa nghĩa là cập nhập tự động ngày giờ bạn sửa đổi trang web lần cuối, để thông báo cho công cụ tìm kiếm biết trang đã thay đổi và liệu nó có cần index lại không.

Bạn có thể hỗ trợ quá trình index (lập chỉ mục) thông qua các liên kết nội bộ, đặc biệt là điều hướng toàn trang trên di động, breadcrumb, bộ lọc nhanh và các liên kết nội dung liên quan.

Bots crawl website có nên được truy cập các thuộc tính web không?

Web crawler bots có nên được truy cập các thuộc tính web không còn phụ thuộc vào thuộc tính web đó là gì cùng một số yếu tố khác kèm theo.

Sở dĩ web crawlers yêu cầu nguồn từ máy chủ là để lấy cơ sở index nội dung – chúng đưa ra các yêu cầu mà máy chủ cần phản hồi, chẳng hạn như thông báo khi có người dùng truy cập website hoặc các bot khác truy cập vào website.

Tùy thuộc vào số lượng nội dung trên mỗi trang hoặc số lượng trang trên website mà các nhà điều hành trang web cân nhắc có nên index các tìm kiếm quá thường xuyên không, vì index quá nhiều có thể làm hỏng máy chủ, tăng chi phí băng thông hoặc cả hai.

Ngoài ra, các nhà phát triển web hoặc công ty có thể không muốn hiển thị một số website nào đó trừ khi người dùng đã được cung cấp link đến trang.

Ví dụ:

Một ví dụ khác có thể là khi một trang web chia sẻ nhiều loại thông tin, và chủ sở hữu muốn kiểm soát việc hiển thị những thông tin cụ thể cho các nhóm người dùng:

Trang web chứa cả tin tức và thông tin sản phẩm. Chủ sở hữu muốn đảm bảo rằng các công cụ tìm kiếm chỉ hiển thị tin tức trong kết quả tìm kiếm và không hiển thị thông tin sản phẩm. Họ có thể sử dụng thẻ “no index” hoặc “disallow” để kiểm soát việc này. Điều này giúp tạo ra sự tập trung vào nội dung chính mà họ muốn người dùng thấy.

Ngoài ra, một trang web thương mại điện tử có thể muốn chặn trang giỏ hàng và trang thanh toán khỏi việc hiển thị trong kết quả tìm kiếm, vì những trang này không cung cấp giá trị cho người dùng thông qua công cụ tìm kiếm.

Như vậy, việc kiểm soát quá trình crawl giúp chủ sở hữu trang web điều hướng cách thông tin của họ được hiển thị trong kết quả tìm kiếm và đảm bảo rằng người dùng nhận được trải nghiệm tốt hơn.

Tóm lại, Crawl đóng vai trò quan trọng trong việc biến internet thành một nguồn thông tin khổng lồ và đáng tin cậy cho mọi người trên khắp thế giới. Nó đóng vai trò như một “người kỹ thuật” tự động quét và tổ chức thông tin trên internet để người dùng có thể truy cập và sử dụng một cách dễ dàng. Rất mong bài viết của InterData.vn sẽ mang đến nhiều giá trị cho bạn về Crawl là gì và hiểu sâu hơn về web crawler. Chúc bạn thành công.